作者发现对通过大型语言模型(LLM)“润色”过的短信存在负面反应,尤其是在个人或专业交流中。核心问题不仅仅是措辞改变,而是*失去了个人声音*。 我们潜意识里会理解人们的沟通方式——他们的语气、强调,甚至不完美之处——这对于准确解读至关重要。LLM抹去了这些细微差别,破坏了对话中的自然“同步”。这阻止了接收者真正“了解”发送者,并理解信息在字面意思之外的意图。 作者认为,真实、甚至是不完美的沟通更有价值,允许接收者建立重要的语境理解,并促进真诚的联系。本质上,让一个人的真实声音展现出来比追求完美无瑕更重要。

每日HackerNews RSS

最近的数学研究正在探索一种协作方法,超越传统的个人工作,利用社区输入和人工智能。Polymath项目和协作形式化努力展示了这种转变,最终促成了2024年等式理论项目(ETP)。ETP成功地利用人工智能和形式化验证解决了普遍代数中超过2200万个真假问题。

现在,SAIR基金会发起一项新的竞赛挑战,旨在将ETP的结果“提炼”成一份简洁的“作弊单”——一套小的指导原则,以提高较小、功能较弱的人工智能模型的性能。目前,这些廉价模型的表现处于随机水平,但研究人员相信,设计良好的作弊单可以提高它们的准确性。

这项挑战以一个公开测试“游乐场”启动,邀请参与者创建这些作弊单(小于10KB),并将通过多个阶段进行,最终不仅需要答案,还需要证明或反例。目标是发现适用于更广泛数学挑战的有效问题解决技术,并可能在其他数学领域复制这种提炼过程。

## 布朗T3与iPod:设计遗产 1958年由迪特·拉姆斯设计的布朗T3袖珍收音机是一款革命性的设备,优先考虑极简主义美学和用户友好的功能。它简洁的外形和直观的控制与当时笨重的收音机形成鲜明对比,体现了拉姆斯“少即是多”的设计理念。 几十年后,这款收音机成为了苹果iPod的关键灵感来源。史蒂夫·乔布斯和他的团队钦佩T3的简洁性、便携性和简洁的线条,直接影响了iPod标志性的设计——从其矩形形状和滚轮到其配色方案。 T3预示了iPod对简化导航和直观用户体验的关注,最终促成了一场音乐消费方式的革命。 这两种设备都展示了具有远见的设计的持久力量,并继续激励着消费电子领域的创新。

## 搜索蒸馏提升语言模型推理能力

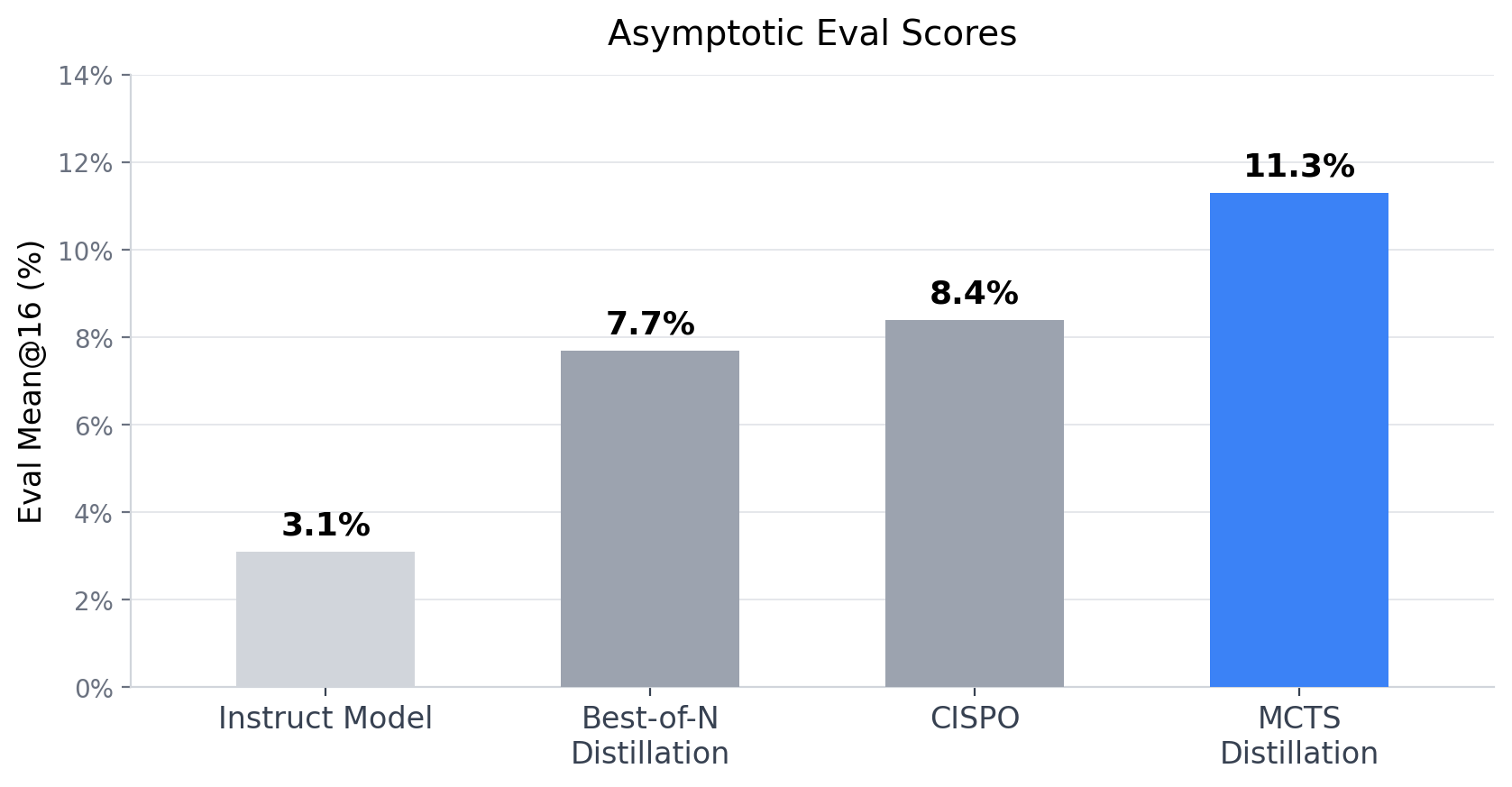

本研究探讨了是否可以通过增强语言模型与搜索功能(类似于AlphaZero等游戏AI使用的技术),来提升其推理能力。作者研究了将蒙特卡洛树搜索(MCTS)应用于Qwen-2.5-1.5B-Instruct模型,并通过在线PPO训练将由此产生的更强的推理路径蒸馏回模型中。

实验重点是组合算术游戏“Countdown”,在该游戏中,模型必须使用给定的整数和运算来达到目标数字。结果表明,蒸馏后的模型实现了11.3%的mean@16准确率——比预训练模型提高了8.2个百分点——优于CISPO (8.4%) 和“最佳N个”采样基线 (7.7%)。

该研究强调了基于搜索的蒸馏的潜力,表明组合问题尤其受益于自适应推理树。尽管承认实验规模较小(1.5B模型),作者计划使用更大的模型和计算资源来进一步探索这种有前景的方法及其“推理旋钮”,例如worker/迭代次数。代码是开源的,欢迎合作以推进这项研究。

## 搜索蒸馏提升语言模型推理能力

本研究探讨了是否可以通过增强语言模型与搜索功能(类似于AlphaZero等游戏AI使用的技术),来提升其推理能力。作者研究了将蒙特卡洛树搜索(MCTS)应用于Qwen-2.5-1.5B-Instruct模型,并通过在线PPO训练将由此产生的更强的推理路径蒸馏回模型中。

实验重点是组合算术游戏“Countdown”,在该游戏中,模型必须使用给定的整数和运算来达到目标数字。结果表明,蒸馏后的模型实现了11.3%的mean@16准确率——比预训练模型提高了8.2个百分点——优于CISPO (8.4%) 和“最佳N个”采样基线 (7.7%)。

该研究强调了基于搜索的蒸馏的潜力,表明组合问题尤其受益于自适应推理树。尽管承认实验规模较小(1.5B模型),作者计划使用更大的模型和计算资源来进一步探索这种有前景的方法及其“推理旋钮”,例如worker/迭代次数。代码是开源的,欢迎合作以推进这项研究。

一项新的联邦指令,源于2021年基础设施投资和就业法案,将要求从2026年末/2027年起销售的所有新车辆包含先进的驾驶员障碍预防技术。 这本质上意味着通过车内摄像头和传感器持续监控驾驶员的眼睛运动、警觉性和潜在障碍(包括血液酒精浓度)。 该系统可以在检测到障碍时防止点火或限制速度,引发了重大的隐私问题。 虽然法律不*要求*数据共享,但制造商*可能*会收集和利用生物识别数据。 汽车制造商正在反对,理由是技术不可靠、可能出现误报以及预计消费者抵制——预计每辆车的成本将增加100至500美元。 政府认为这种监控每年可以挽救数千人的生命,但批评人士质疑驾驶隐私的权衡是否合理。 现有车辆不受影响,但未来的汽车购买者需要接受这项技术才能购买新车型。

联邦通信委员会(FCC)主席布伦丹·卡尔已向广播公司发出警告,威胁如果新闻报道被认为不利,将不予续期,尤其是在特朗普总统批评美国-以色列袭击及其他问题后的报道。卡尔声称广播公司必须在“公共利益”内运营,并避免“假新闻”,呼应了特朗普要求电视台因 perceived 不公正报道而失去许可的呼吁。 这一举动延伸至《吉米·坎摩尔直播秀》和《观点》等特定节目,促使一些台组(Nexstar & Sinclair)因担心FCC的审查而暂时撤下内容。甚至CBS也面临内部限制,斯蒂芬·科尔伯特将访谈发布在网上而不是播出。 虽然FCC主要对*地方*电视台进行许可,而不是国家网络,但这一立场代表着该机构权力可能过度扩张,并引发了第一修正案的担忧。 过去试图利用许可来控制内容的尝试都面临法律挑战。

启用 JavaScript 和 Cookie 以继续。

GrobPaint 是一款轻量级、跨平台的图像编辑器,旨在填补 Paint.NET 缺乏 macOS 支持的空白。它使用 Web 技术(纯 JavaScript)和最简 Python 后端构建,提供诸如图层、16 种混合模式以及各种选择和绘图工具等基本功能——而无需像 Photoshop 这样复杂的程序。

主要功能包括对 PNG、JPEG、BMP 和 GIF 文件的支持、选项卡式多文档界面以及 .gbp 项目文件,该文件将图层存储为 ZIP 压缩包。它具有缩放和画布调整大小等图像操作功能,并采用简单、无依赖项的构建过程。

GrobPaint 可以作为原生窗口运行(可选 `pywebview`),也可以直接在浏览器中运行。它优先考虑易用性和精简的体验,旨在以紧凑的软件包(大约 2500 行代码,分为专注的 JavaScript 模块)提供“你真正需要的工具”。