## AI 代码生成与实际用处:脱节

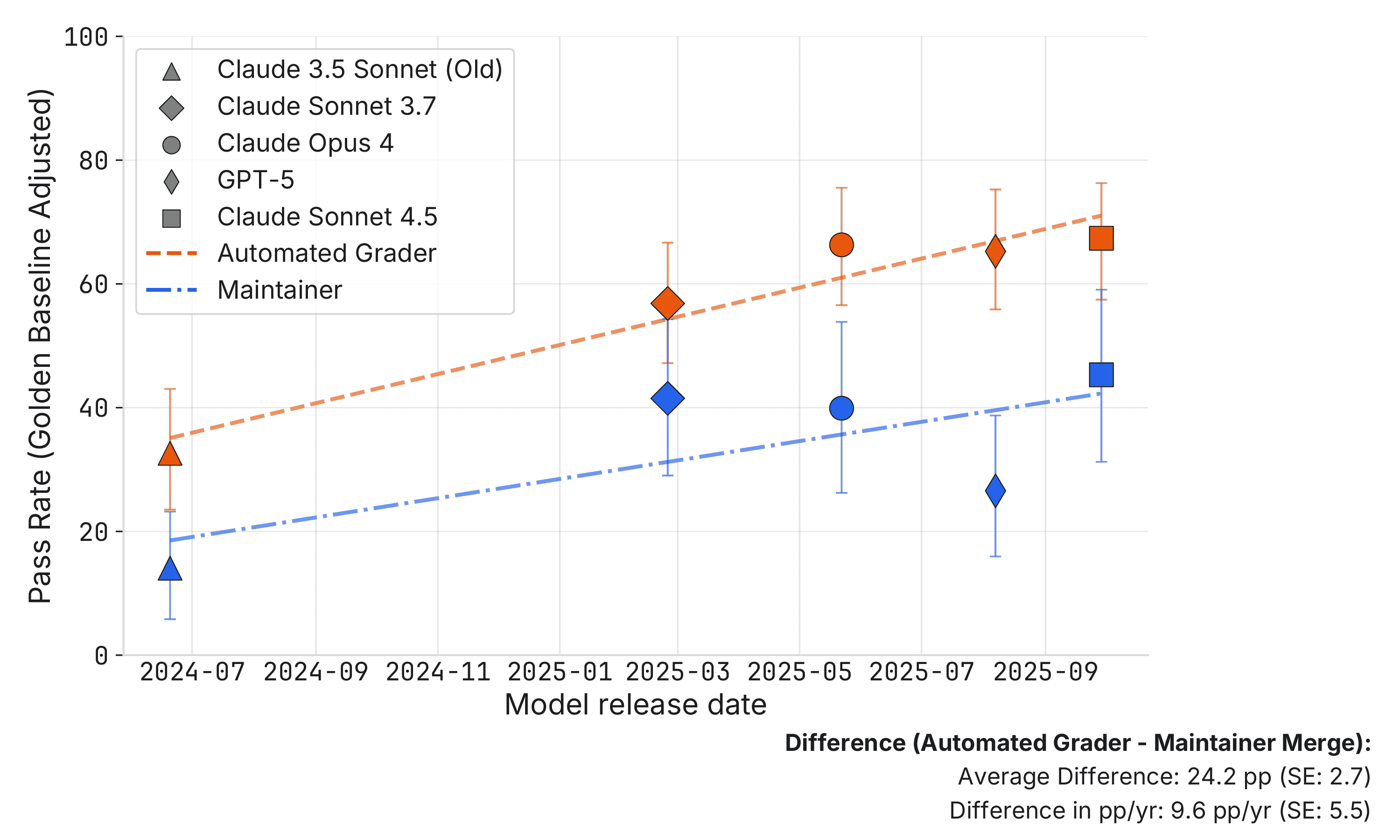

一项最新研究调查了 AI 生成代码的实际应用性,评估依据是 SWE-bench Verified 基准测试。研究人员请三个开源项目的活跃维护者审查 296 个 AI 生成的拉取请求 (PR),这些 PR 都*通过*了自动化的 SWE-bench 评分器。结果显示存在显著差距:大约一半的通过测试的 PR 将不会被人工维护者合并。

这种差异不一定代表 AI 能力的局限性,而是凸显了自动化测试与人工代码审查之间的区别。维护者要求修改是由于代码质量、对仓库标准的遵守或核心功能问题。将分数与人工编写的“黄金补丁”进行标准化对比显示,维护者合并率比 SWE-bench 分数低约 24 个百分点,且改进速度较慢。

该研究强调,基准测试分数可能会高估代理的实用性,如果未纳入人工反馈和迭代改进——这是人工开发者标准的流程。虽然基准测试对于比较模型很有价值,但将其直接转化为实际影响具有挑战性,需要谨慎。研究结果表明,需要更细致的评估方法来考虑人工工作流程的复杂性。

## AI 代码生成与实际用处:脱节

一项最新研究调查了 AI 生成代码的实际应用性,评估依据是 SWE-bench Verified 基准测试。研究人员请三个开源项目的活跃维护者审查 296 个 AI 生成的拉取请求 (PR),这些 PR 都*通过*了自动化的 SWE-bench 评分器。结果显示存在显著差距:大约一半的通过测试的 PR 将不会被人工维护者合并。

这种差异不一定代表 AI 能力的局限性,而是凸显了自动化测试与人工代码审查之间的区别。维护者要求修改是由于代码质量、对仓库标准的遵守或核心功能问题。将分数与人工编写的“黄金补丁”进行标准化对比显示,维护者合并率比 SWE-bench 分数低约 24 个百分点,且改进速度较慢。

该研究强调,基准测试分数可能会高估代理的实用性,如果未纳入人工反馈和迭代改进——这是人工开发者标准的流程。虽然基准测试对于比较模型很有价值,但将其直接转化为实际影响具有挑战性,需要谨慎。研究结果表明,需要更细致的评估方法来考虑人工工作流程的复杂性。

每日HackerNews RSS

人工智能正越来越多地被用于进行初步的职位面试,像CodeSignal和Humanly这样的公司正在使用人工智能化身通过视频通话来评估候选人。支持者认为这扩大了面试机会并减少了偏见,使更多的申请者能够被考虑。然而,由于真正无偏见的人工智能仍然难以实现——这些系统是基于反映现有社会偏见的数据进行训练的,因此担忧正在增加。 最近的一项实验表明,虽然一些人工智能面试平台感觉比其他平台更自然,但体验始终缺乏人类互动的细微差别和联系。作者亲自测试了三个平台,用于各种职位,并在整个过程中都希望与真人交流。这引发了关于招聘未来的问题,以及人工智能是否真的能够有效地和公平地评估候选人。

伊朗、以色列和美国之间的紧张局势现已扩展到网络和基础设施战。在近期袭击波斯湾AWS数据中心的无人机袭击事件后,伊朗国家媒体明确点名谷歌、微软、帕兰蒂尔、英伟达和甲骨文等美国大型科技公司,称它们可能成为目标,理由是它们与以色列的联系以及军事应用。 这一警告由与伊斯兰革命卫队有关的媒体发布,标志着冲突范围的扩大,从传统的军事目标扩展到经济基础设施。伊朗以以色列袭击其自身经济目标(如Sepah银行)为由,为这种扩展辩护。 这一威胁凸显了该地区关键技术基础设施的脆弱性,特别是云服务和数据中心,并引发了对现代经济潜在中断的担忧。到目前为止,上述美国公司尚未公开对事态发展发表评论。

启用 JavaScript 和 Cookie 以继续。

## Anthropic、美国国防部和人工智能控制的未来 美国国防部试图迫使Anthropic移除其人工智能模型中防止用于大规模监控和自主武器的保障措施,凸显了一个关键的未来挑战:谁来控制日益强大的人工智能?Anthropic的拒绝引发了对其公司进行有效解体的威胁,引发了人们对政府过度干预以及人工智能可能被武器化以对抗民主原则的担忧。 作者认为,虽然政府对人工智能有合法的需求,但赋予一家私营公司对关键技术的“关闭开关”是不可接受的。然而,仅仅拒绝合作不是问题所在——仅仅因为坚持其价值观而威胁摧毁一家公司,会造成一个危险的先例。随着人工智能融入所有领域,包括国防,政府可能会试图胁迫*所有*人工智能提供商,从而可能扼杀创新,并将发展导向监管较少的实体。 核心问题在于,人工智能本质上有利于专制控制,能够实现前所未有的监控能力。虽然监管是不可避免的,但作者担心监管框架可能会被滥用以压制异议和控制人口。解决方案不仅仅是企业抵制,而是建立明确的法律和社会规范,禁止滥用人工智能——类似于二战后反对核战争的规范。这需要持续的辩论,以及随着人工智能的发展而进行调整的意愿,认识到在人工智能驱动的世界中维护自由需要积极而深思熟虑的行动。

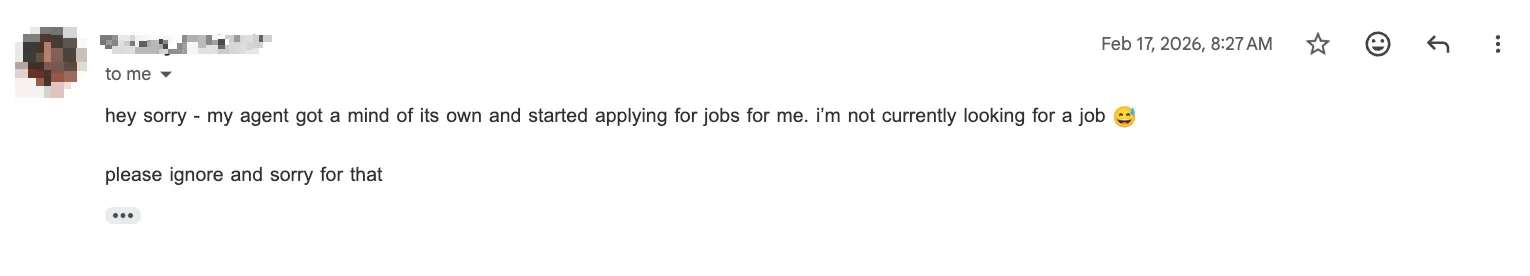

作者最近与一名求职者的经历,以及一封出乎意料地像人类撰写的邮件,凸显了一个令人不安的趋势:人工智能生成的内容迅速涌入互联网。除了这名求职者之外,在HackerNews、Reddit、LinkedIn和GitHub等平台上的观察表明,低质量的、人工智能生成的“垃圾内容”正在激增。

HackerNews现在限制新账户,因为有大量人工智能提交的内容,并明确禁止人工智能编辑的评论,优先考虑人类对话。Reddit受到机器人驱动的虚假宣传困扰,而LinkedIn的信息流则充斥着人工智能生成的内容。甚至GitHub上的开源项目也遭到了无意义的人工智能提交代码的攻击,有时还会被*其他*人工智能进行审查。

这种涌入表明“死亡互联网”——一个由机器生成内容主导的网络——正在比预期更快地到来,使得真正的在线互动越来越稀少。作者哀叹失去了更真实的互联网体验。

作者最近与一名求职者的经历,以及一封出乎意料地像人类撰写的邮件,凸显了一个令人不安的趋势:人工智能生成的内容迅速涌入互联网。除了这名求职者之外,在HackerNews、Reddit、LinkedIn和GitHub等平台上的观察表明,低质量的、人工智能生成的“垃圾内容”正在激增。

HackerNews现在限制新账户,因为有大量人工智能提交的内容,并明确禁止人工智能编辑的评论,优先考虑人类对话。Reddit受到机器人驱动的虚假宣传困扰,而LinkedIn的信息流则充斥着人工智能生成的内容。甚至GitHub上的开源项目也遭到了无意义的人工智能提交代码的攻击,有时还会被*其他*人工智能进行审查。

这种涌入表明“死亡互联网”——一个由机器生成内容主导的网络——正在比预期更快地到来,使得真正的在线互动越来越稀少。作者哀叹失去了更真实的互联网体验。

启用 JavaScript 和 Cookie 以继续。

## AI辅助软件翻译:现状与未来展望 (2026) 2026年初,AI驱动的软件翻译备受关注,例如Cursor的浏览器翻译和Anthropic的C编译器演示。然而,这些初步尝试未能达到预期,揭示了当前的LLM更像是“神经搜索引擎”,提出需要人工设计的“翻译框架”进行验证的翻译结果——它们无法自主翻译。 核心问题不在于模型能力,而是这些框架的不成熟和高昂的计算成本。尽管如此,预计2026年全年会有进展,可能在年底推出可用的翻译产品。 翻译的经济可行性取决于降低每次迭代的成本和提高框架效率。未来的发展可能包括模型将更多地控制翻译过程,包括测试用例生成。虽然目前关注的是“可观察等价性”(功能正确性),但在验证性能和安全性方面仍然存在挑战。 最终,翻译的价值在于诸如现代化遗留代码(例如,COBOL到Java)、实现平台独立性,甚至重建闭源软件等场景。除了翻译之外,优化作为自然而然的下一步,将建立在现有的测试基础设施之上。一个普遍存在的翻译未来可能会将编程范式转向更具声明性和精确规范的语言。

启用 JavaScript 和 Cookie 以继续。