约翰·阿奇博尔德·惠勒曾用一个循环来描述引力:物质告诉空间如何弯曲,空间告诉物质如何运动。爱因斯坦的广义相对论通过时空几何解释了这一点,但在量子尺度上(例如黑洞内部)却失效了。 为了弥合这一差距,物理学家们正在使用“全息原理”,将三维时空映射到二维量子粒子表面。先前的研究将量子“纠缠”确定为赋予空间结构的连接组织。然而,这些早期模型产生的是一种“惰性”空间——它虽然存在,却无法弯曲或对物质做出反应。 查尔斯·曹等研究人员近期的突破发现了一个缺失的要素:“魔力”(magic)。在量子计算中,魔力是指引入量子态复杂性的非克利福德门(non-Clifford gates)。通过将这些门整合到量子纠错码中,科学家们证明了“魔力”就像织物柔顺剂一样,使空间变得灵活。这表明引力是量子力学的直接表现,当空间被编码足够的复杂性以允许物质与几何结构相互作用时,引力便随之产生。尽管尚处于早期阶段,但这种方法将时空视为量子信息的一种涌现属性。

每日HackerNews RSS

在这篇文章中,Safia Abdalla 探讨了 ANSI 转义码的深远影响。这一标准始于 1979 年,至今仍是终端交互的基石。 该标准最初旨在让“哑”CRT 终端能够在纯文本流中处理文本格式、颜色和光标移动等指令。其工作原理是在文本中插入特定的转义序列(以 `\x1b[` 开头),现代模拟器会将这些序列解释为命令,而非可见文本。 虽然该标准最初仅支持 8 种基础颜色,但如今已进化为支持现代 24 位 RGB 真彩色,以及进度条、加载动画和像 Vim 这样的全屏应用等复杂的 UI 元素。如今,开发者会使用 `chalk` 或 `Spectre.Console` 等库来封装这些代码,从而创建出复杂且交互性强的命令行界面。Abdalla 最终强调,理解这些已有 50 年历史的标准,不仅能让我们洞察当前的软件设计如何跨越数十年保持生命力,同时也展现了通过使用这些“咒语”构建现代终端体验的乐趣。

ESP32 Bit Pirate 是一款开源的多协议黑客工具,可将 ESP32-S3 设备转变为通用的诊断与开发平台。该固件受传奇工具 Bus Pirate 的启发,支持 I2C、SPI、UART、1-Wire、JTAG 和 CAN 等多种数字协议,并增加了 Wi-Fi、蓝牙、RFID、Sub-GHz(亚吉赫兹)和红外等强大的无线通信功能。

用户可以通过 Web 界面、串行终端或独立模式(在 M5 Cardputer 等支持的硬件上)与设备交互。它支持基于 Python 的高级脚本功能,可实现 EEPROM 转储、信号分析和协议嗅探等任务的自动化。该生态系统包含专用的硬件底座和扩展板,确保了与传统 Bus Pirate 配件的兼容性。

该固件专为教育、诊断和互操作性测试而设计,具有高度可扩展性和易用性,并通过 Web 烧录器实现一键安装。此外,还提供详尽的文档和社区驱动的脚本,以辅助设备操控和数据记录。

*注意:本工具仅供授权使用。用户必须严格遵守 3.3V/5V 逻辑电平及当地电信法规,以避免设备损坏或法律问题。*

ESP32 Bit Pirate 是一款开源的多协议黑客工具,可将 ESP32-S3 设备转变为通用的诊断与开发平台。该固件受传奇工具 Bus Pirate 的启发,支持 I2C、SPI、UART、1-Wire、JTAG 和 CAN 等多种数字协议,并增加了 Wi-Fi、蓝牙、RFID、Sub-GHz(亚吉赫兹)和红外等强大的无线通信功能。

用户可以通过 Web 界面、串行终端或独立模式(在 M5 Cardputer 等支持的硬件上)与设备交互。它支持基于 Python 的高级脚本功能,可实现 EEPROM 转储、信号分析和协议嗅探等任务的自动化。该生态系统包含专用的硬件底座和扩展板,确保了与传统 Bus Pirate 配件的兼容性。

该固件专为教育、诊断和互操作性测试而设计,具有高度可扩展性和易用性,并通过 Web 烧录器实现一键安装。此外,还提供详尽的文档和社区驱动的脚本,以辅助设备操控和数据记录。

*注意:本工具仅供授权使用。用户必须严格遵守 3.3V/5V 逻辑电平及当地电信法规,以避免设备损坏或法律问题。*

Ladybird 项目正在转向闭源贡献模式,仅限项目维护者提交代码。公开的合并请求(pull requests)将不再被接受,目前所有未关闭的请求都将被关闭。 这一决定源于开源开发环境的变化,特别是人工智能工具的兴起。此前,代码贡献是衡量信任和投入的可靠指标。然而,由于 AI 现在可以快速生成复杂的代码,这些提交已无法再提供同样的诚信保证。随着 Ladybird 接近首次 Alpha 版本发布,团队必须优先考虑安全性和架构完整性;他们认为,只有直接负责维护浏览器的人,才应引入可能影响用户安全的代码变更。 虽然 Ladybird 仍保持开源,并将继续欢迎社区通过错误报告、安全反馈和设计讨论提供意见,但将不再维持正式的外部代码提交流程。维护者强调,随着浏览器为投入实际使用做准备,这一转变对于确保他们能对浏览器承担全部责任是必要的。

本项目探索了如何将 Raspberry Pi Pico (RP2350) 与 Z80 CPU 接口,以监测并交互其地址总线和数据总线。作者利用一块定制的转接 PCB,将 RP2350 的 GPIO 引脚连接至 Z80 的 16 位地址总线、8 位数据总线,以及关键的控制线路(如 /RD、/WR、/IORQ 等)。

核心重点在于理解 Z80 的总线时序,特别是确保同步所需的时钟要求。作者利用 RP2350 的高速 GPIO 能力对 Z80 总线进行轮询,通过仿真离散 TTL 逻辑芯片来实现数据捕获。通过 RC2014 计算机执行 I/O 写入的演示,验证了该方案的可行性——RP2350 能够检测到写入操作并更新本地 LED 显示。

虽然目前仅在单核心上使用了简单的非同步轮询,但作者计划将其升级为更稳健的接口。未来的目标包括实现双向 I/O、内存映射设备仿真,以及利用 RP2350 的 PIO(可编程 I/O)模块进行自主总线管理,这可能使 RP2350 能够控制 Z80 时钟,从而实现精确的指令级单步调试。

本项目探索了如何将 Raspberry Pi Pico (RP2350) 与 Z80 CPU 接口,以监测并交互其地址总线和数据总线。作者利用一块定制的转接 PCB,将 RP2350 的 GPIO 引脚连接至 Z80 的 16 位地址总线、8 位数据总线,以及关键的控制线路(如 /RD、/WR、/IORQ 等)。

核心重点在于理解 Z80 的总线时序,特别是确保同步所需的时钟要求。作者利用 RP2350 的高速 GPIO 能力对 Z80 总线进行轮询,通过仿真离散 TTL 逻辑芯片来实现数据捕获。通过 RC2014 计算机执行 I/O 写入的演示,验证了该方案的可行性——RP2350 能够检测到写入操作并更新本地 LED 显示。

虽然目前仅在单核心上使用了简单的非同步轮询,但作者计划将其升级为更稳健的接口。未来的目标包括实现双向 I/O、内存映射设备仿真,以及利用 RP2350 的 PIO(可编程 I/O)模块进行自主总线管理,这可能使 RP2350 能够控制 Z80 时钟,从而实现精确的指令级单步调试。

在这篇文章中,作者尝试撰写一篇简明扼要的短文,以改掉以往产出过于冗长内容的习惯。文章重点介绍了如何在 R 语言中实现“线性余弦调色板”(linear cosine palettes),这是一种用于生成连续色板的简便程序化方法。 该技术最初由 Inigo Quilez 提出,并由 Mike Cheng 引入 R 语言。它利用余弦函数 $f(t) = \mathbf{a} + \mathbf{b} \ \cos(2 \pi(\mathbf{c} t + \mathbf{d}))$,通过随机选择的基向量来创建平滑且美观的色彩过渡。作者提供了一个紧凑的 R 函数来实现该方法,并展示了这些调色板以条带形式呈现的效果。 为了测试这些调色板的实际应用,作者将其应用于两种生成艺术系统:矩形细分法和利萨茹曲线生成器。尽管几乎没有进行优化,但这些调色板仍产生了高质量的效果。作者最后总结称,该方法非常高效,且最重要的是,成功完成了撰写一篇简明、专注的博文这一练习。

**isUpMap** 是一个实时状态仪表板,用于监控超过 80 种热门互联网服务的运行状况。该平台通过基于 JavaScript 的实时热力图,让用户能够直观地了解关键工具是处于正常运行、性能下降还是当前宕机状态。 该服务覆盖了广泛的关键基础设施,包括: * **人工智能:** OpenAI、Anthropic、xAI、Groq 等。 * **开发与云服务:** GitHub、AWS、Vercel、Cloudflare 和 Docker。 * **商业与生产力:** Slack、Discord、Stripe、Notion、Figma 和 Shopify。 除了当前的运行状态检查外,isUpMap 还追踪故障历史记录及各服务的在线率统计数据。用户可以浏览完整目录来核实特定工具的状态,或开启桌面通知,以便在服务发生中断时立即收到提醒。对于依赖持续在线以进行日常工作的开发者和专业人士来说,这是一款必不可少的工具。

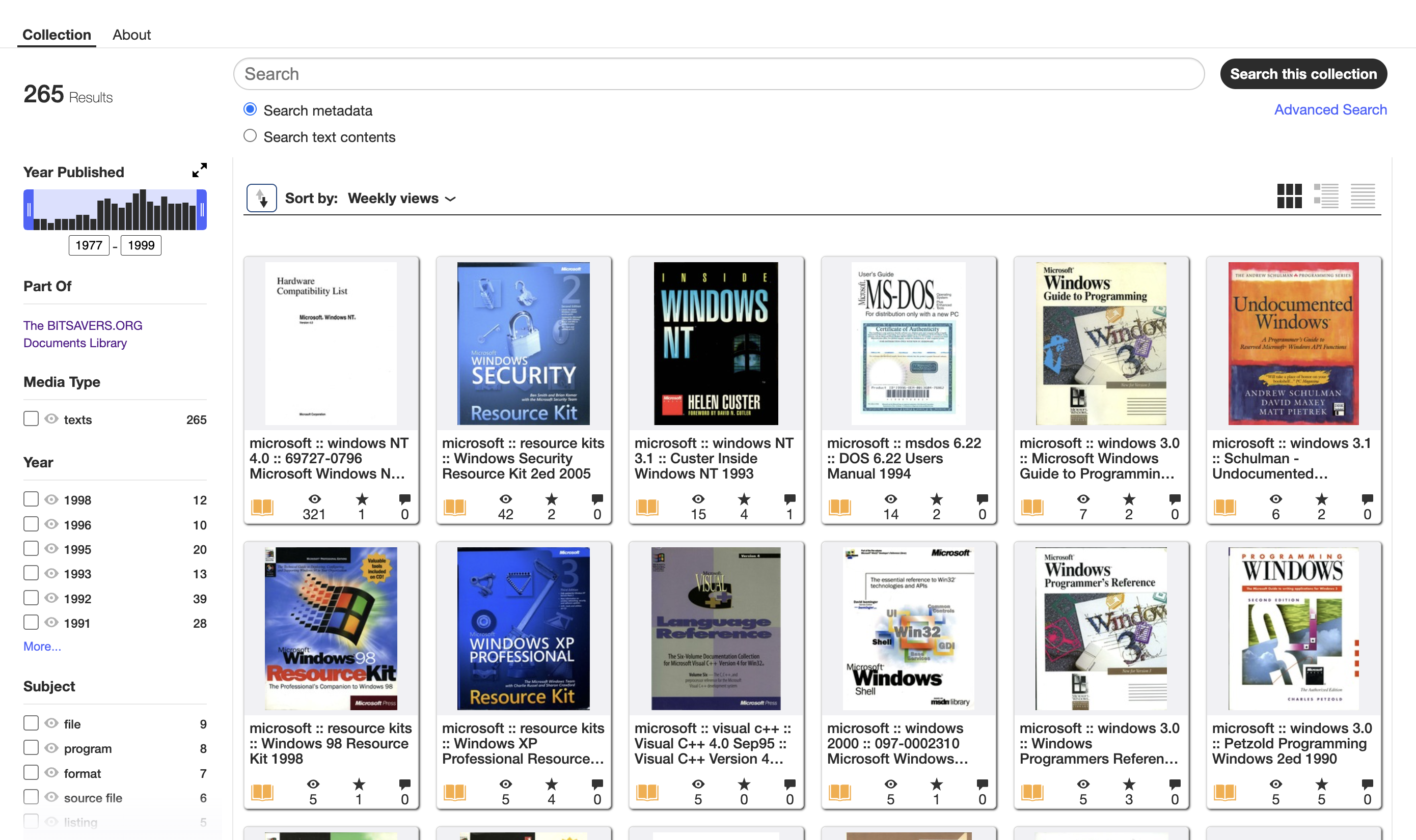

作者探讨了“本地优先”人工智能的可行性,通过微调开源大语言模型(Llama 3.1 8B 和 Qwen 2.5 7B),使其能够模仿 20 世纪 90 年代微软技术文档的写作风格。

作者使用了来自“Bitsavers”档案库中超过 3700 万字的语料,在清洗数据后,通过云端 GPU 运用 QLoRA(量化低秩适应)技术创建了专用适配器。这一过程使模型能够掌握独特的、符合时代特征的技术语调,从而将 90 年代的文档结构成功应用于现代或虚构的概念中。

实验表明,微调是一种有效且经济的方式,能够赋予模型特定的文体“声音”或内部写作标准。然而,作者强调这并非万能方案:它需要高质量的数据整理、对训练参数(如秩和轮次)的严谨管理,以及在模型表达力和事实可靠性之间取得平衡。最终,作者总结认为,尽管这些经过微调的模型在模仿方面表现出色,并能有效辅助作家的工作流程,但它们仍缺乏取代技术写作者所需的人类判断力。

作者探讨了“本地优先”人工智能的可行性,通过微调开源大语言模型(Llama 3.1 8B 和 Qwen 2.5 7B),使其能够模仿 20 世纪 90 年代微软技术文档的写作风格。

作者使用了来自“Bitsavers”档案库中超过 3700 万字的语料,在清洗数据后,通过云端 GPU 运用 QLoRA(量化低秩适应)技术创建了专用适配器。这一过程使模型能够掌握独特的、符合时代特征的技术语调,从而将 90 年代的文档结构成功应用于现代或虚构的概念中。

实验表明,微调是一种有效且经济的方式,能够赋予模型特定的文体“声音”或内部写作标准。然而,作者强调这并非万能方案:它需要高质量的数据整理、对训练参数(如秩和轮次)的严谨管理,以及在模型表达力和事实可靠性之间取得平衡。最终,作者总结认为,尽管这些经过微调的模型在模仿方面表现出色,并能有效辅助作家的工作流程,但它们仍缺乏取代技术写作者所需的人类判断力。

《拦截》(The Intercept)的一项调查显示,美国军方正在利用名为“La Tilde”的新型人工智能内容工厂在拉美地区散布宣传信息。该网站作为美国南方特种作战司令部(SOCSOUTH)的消息发布平台,以现代新闻品牌的名义进行伪装,其内容既包含个人理财建议,也充斥着大力鼓吹美国军事行动的文章。 该网站高度依赖人工智能生成的文本和图像,这些内容往往质量低劣且存在视觉错误。它将其政府背景隐藏在“关于我们”页面中一段不易被察觉的声明之后,这种策略与五角大楼资助的其他宣传网络如出一辙。尽管该网站声称雇佣了数十名记者,但实际上并无专业的编辑团队,而是通过数字营销分包商来推动有利于美国地缘政治利益的叙事,例如联合军事演习和备受争议的地区干预行动。专家指出,虽然这些内容显得“敷衍”且人工智能的运用粗制滥造,但此类平台使军方能够快速调整并扩大影响力行动的规模,这引发了人们对透明度以及利用自动化宣传来塑造外国舆论的严重担忧。