## 互联网与语言的演变:摘要 格雷琴·麦卡洛的《因为互联网》和亚当·亚历西克的《算法语言》都探讨了互联网如何塑造语言,但采用了不同的方法。麦卡洛从历史和语言学的角度出发,追溯了在线交流的演变,从早期的BBS系统到表情符号,认为互联网复兴了曾被正式规范边缘化的非正式书写。她将表情符号视为手势,是现代书面语言不可或缺的一部分。 然而,亚历西克则侧重于社交媒体*算法*的控制性影响。《算法语言》详细描述了平台如何优先考虑广告收入,迫使用户开发编码语言(例如,用“unalive”代替自杀),以逃避内容审核。他强调了Vine甚至在线“incel”社群等平台,作为新俚语出人意料的生产源。 虽然两人都承认互联网的影响,但亚历西克的作品更具批判性,揭示了算法如何对用户进行分类和营销,可能扼杀真正的个性。他甚至注意到人们在语音表达上承受着模仿MrBeast等成功内容创作者的压力。最终,《算法语言》激起了评论员的愤怒,促使人们希望出现像Mastodon和Bluesky这样的去中心化社交媒体平台,在那里语言可以自由地、摆脱算法控制地有机演变。

每日HackerNews RSS

这是威廉·吉布森广受好评的“蔓延三部曲”——《神经漫游者》、《零计数》和《蒙娜丽莎超载》——的数字版本,由Voyager出版社于1991年作为其“扩展图书项目”的一部分发布。该项目旨在优化在电脑屏幕上的阅读体验,侧重于排版和数字出版细节。 这个特定版本包含吉布森之前未发表的一篇后记。它最初以1.4MB软盘的形式分发给Macintosh电脑(68k架构,System 6.0.7或更高版本,需要HyperCard 2.1)。 安装过程包括挂载磁盘镜像、提取文件并将字体复制到System文件夹。书本身通过一个名为“The Library”的应用程序访问,但它们按字母顺序显示,而非按时间顺序。现代用户可以通过Basilisk II等模拟软件访问它。

Widevine 的 CLS 是 Google 提供的免费服务,供 Widevine 许可方生成 DRM 许可证。此服务端点允许内容分发商使用 Google 的基础设施,而不是完全运营自己的 Widevine 许可服务器或与第三方 DRM 供应商合作。对于一些人来说,这是一个便捷的入口——但它也有一些权衡:作为免费服务,无法获得支持和有价值的功能。或者,Google 还向许可方提供“Widevine 许可服务器 SDK”,以便在他们自己的基础设施上执行 100% 的端到端 DRM 许可证生成/交付——无需与 Widevine CLS 通信。许多第三方云多 DRM 提供商已经在使用此 SDK——这也使他们能够提供改进的服务级别和优势。例如,以下是使用 Widevine CLS 与使用具有 Widevine 许可服务器 SDK 的托管 DRM 提供商(如 DRMtoday)之间的差异:

## AI生成代码的信任挑战 随着像Claude这样的人工智能代理越来越多地自主编写代码,一个关键问题出现了:我们如何*知道*代码是正确的?传统的代码审查难以跟上变化的数量,而依赖人工智能来测试其自身的工作会形成自我验证的循环,从而忽略了根本的误解。 解决方案不是增加审查员,而是回归测试驱动开发(TDD)的核心原则:**在编写代码*之前*定义什么是“正确”的。** 工程师不应提示解决方案,而应首先编写清晰、具体的**验收标准**——对所需功能的纯英文描述(例如,“用户在凭据错误时看到‘无效的电子邮件或密码’”)。 然后,人工智能可以根据这些标准构建,并使用自动化验证(例如,对于前端使用Playwright,对于后端使用`curl`)可以严格地针对这些标准进行测试。这会将审查重点从复杂的差异转移到简单的通过/失败报告,仅突出实际的失败。 虽然这不能消除所有错误(不正确的规范仍然会产生有缺陷的结果),但它通过捕获集成问题并确保代码按*预期*运行,从而显著提高可靠性,从而提供了一种比仅仅依赖人工智能驱动的代码审查更可靠的方法。像`opslane/verify`这样的工具使用Claude和Playwright简化了这个过程。

arXivLabs是一个框架,允许合作者直接在我们的网站上开发和分享新的arXiv功能。个人和与arXivLabs合作的组织都认同并接受我们开放、社群、卓越和用户数据隐私的价值观。arXiv致力于这些价值观,并且只与秉持这些价值观的合作伙伴合作。您是否有为arXiv社群增加价值的项目想法?了解更多关于arXivLabs的信息。

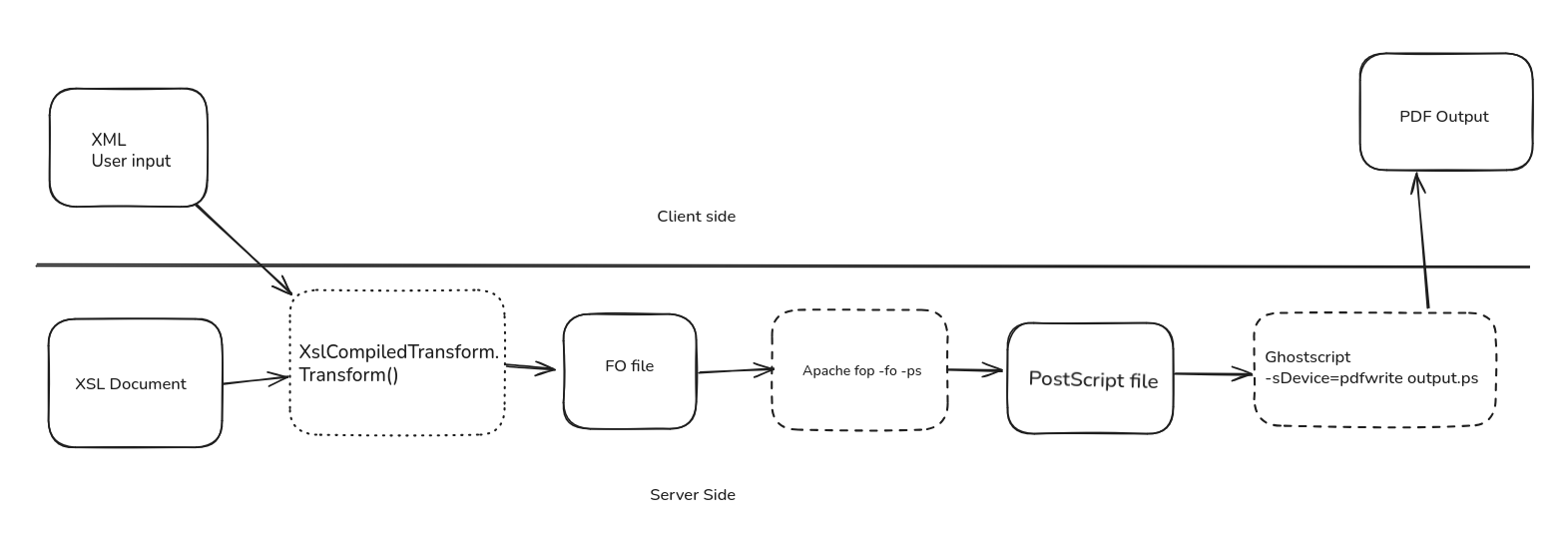

## Apache FOP & GhostScript 漏洞摘要

一名安全研究人员发现了一个漏洞,该漏洞存在于使用 Apache FOP 将用户提供的 XML 转换为 PostScript,然后使用 GhostScript 生成 PDF 的应用程序中。虽然 GhostScript 包含用于安全性的沙箱,但 FOP 处理用户输入的方式存在缺陷,导致潜在的代码执行。

问题源于生成的 PostScript 代码中字符的转义不足。具体来说,精心构造的 XML 输入可以绕过 FOP 的转义机制并注入任意 PostScript 指令。FOP 的换行功能加剧了这一问题,该功能引入了进一步破坏转义逻辑的换行符。

通过利用这一点,研究人员可以注入诸如 `showpage` 和文件访问指令之类的命令,最终直接从服务器的文件系统中读取敏感文件(例如 Docker 挑战中的 flag)。一个关键的解决方法是使用不间断空格来防止 FOP 分割命令。

虽然完全逃逸沙箱是可能的,但研究人员成功利用该漏洞读取了一个 flag 文件。Apache FOP 不会修复底层问题,而是选择改进有关预期安全属性的文档。研究人员还利用了另一个 Windows 漏洞 (CVE-2025-46646) 以获得更广泛的文件系统访问权限。

## Apache FOP & GhostScript 漏洞摘要

一名安全研究人员发现了一个漏洞,该漏洞存在于使用 Apache FOP 将用户提供的 XML 转换为 PostScript,然后使用 GhostScript 生成 PDF 的应用程序中。虽然 GhostScript 包含用于安全性的沙箱,但 FOP 处理用户输入的方式存在缺陷,导致潜在的代码执行。

问题源于生成的 PostScript 代码中字符的转义不足。具体来说,精心构造的 XML 输入可以绕过 FOP 的转义机制并注入任意 PostScript 指令。FOP 的换行功能加剧了这一问题,该功能引入了进一步破坏转义逻辑的换行符。

通过利用这一点,研究人员可以注入诸如 `showpage` 和文件访问指令之类的命令,最终直接从服务器的文件系统中读取敏感文件(例如 Docker 挑战中的 flag)。一个关键的解决方法是使用不间断空格来防止 FOP 分割命令。

虽然完全逃逸沙箱是可能的,但研究人员成功利用该漏洞读取了一个 flag 文件。Apache FOP 不会修复底层问题,而是选择改进有关预期安全属性的文档。研究人员还利用了另一个 Windows 漏洞 (CVE-2025-46646) 以获得更广泛的文件系统访问权限。

(Empty input provided. There is nothing to translate.)

## GPU转码变得简单:ffmpeg-over-ip ffmpeg-over-ip 提供GPU加速的ffmpeg转码,无需GPU直通、共享文件系统或驱动对齐的复杂性。它允许应用程序通过将`ffmpeg`命令替换为`ffmpeg-over-ip-client`,即可利用远程GPU进行媒体服务器转码等任务。 该系统通过在具有GPU访问权限的服务器上运行,并在包含文件的机器上运行客户端来工作。客户端通过单个TCP端口将命令和文件I/O转发到服务器,服务器执行一个补丁后的ffmpeg。重要的是,文件*从不*驻留在服务器上,从而无需NFS、SMB或复杂的挂载。 包含支持NVENC、QSV和其他硬件加速方法的预构建二进制文件,简化了设置。多个客户端可以同时连接到单个服务器,每个客户端都有自己的ffmpeg进程,并受到HMAC身份验证的保护。它是一种简化解决方案,可在Docker、VM和远程机器等各种环境中利用GPU性能。

## AMI 启动,获得 10 亿美元资金,致力于“世界模型”人工智能 Meta 前首席人工智能科学家 Yann LeCun 在巴黎联合创立了 Advanced Machine Intelligence (AMI),获得了超过 10 亿美元的资金,用于开发人工智能“世界模型”。LeCun 认为,当前人工智能的发展,专注于像 ChatGPT 这样的大型语言模型 (LLM),是实现真正人类水平智能的死胡同。他认为,人工智能需要理解*物理*世界,而不仅仅是语言,才能真正地推理和规划。 AMI 估值 35 亿美元,旨在创建具有持久记忆、可控性和安全性的 AI 系统,目标行业包括制造业、生物医学和机器人技术。该公司将在巴黎、蒙特利尔、新加坡和纽约等地全球运营。 这项举措代表着对 OpenAI 甚至 LeCun 前雇主 Meta 所倡导的 LLM 方法的重大反*对*。虽然承认 LLM 的实用性,但 LeCun 将其视为一种临时趋势,认为世界模型对于真正的人工智能发展至关重要,并且最好独立商业化。他获得了 Zuckerberg 的祝福,离开了 Meta 来追求这一愿景。

## AI辅助编程:熟练度等级 人工智能的编程*能力*正在迅速提升,但要充分发挥其*益处*,需要培养有效利用它的技能。这种进步并非追求最高的SWE-bench分数,而是弥合人工智能*能够*做的事情与我们如何*应用*它之间的差距。 作者概述了**八个**AI辅助编程熟练度等级。它从基本的**代码补全**(等级1)等功能开始,逐步发展到利用AI驱动的IDE进行多文件编辑(等级2)。**上下文工程**(等级3)——优化提示的清晰度——至关重要,并演变为**复合工程**(等级4),将经验教训编码为未来会话的规则。 等级5-7通过**定制工具和技能**(MCPs)解锁显著收益,赋予人工智能访问数据库、API和测试框架的权限,并最终**编排后台代理**以自主处理任务。当前的边界,**等级8**,涉及完全自主的代理团队直接协调,但管理复杂性仍然存在挑战。 关键要点是,每一层都建立在上一层之上,通过改进的模型来放大收益。在团队范围内投资熟练度——确保每个人不会被速度较慢的同事拖累——至关重要。未来指向更自然的界面,如语音控制,但核心原则仍然是:迭代开发,由越来越强大和自主的人工智能代理提供支持。