## GPU转码变得简单:ffmpeg-over-ip ffmpeg-over-ip 提供GPU加速的ffmpeg转码,无需GPU直通、共享文件系统或驱动对齐的复杂性。它允许应用程序通过将`ffmpeg`命令替换为`ffmpeg-over-ip-client`,即可利用远程GPU进行媒体服务器转码等任务。 该系统通过在具有GPU访问权限的服务器上运行,并在包含文件的机器上运行客户端来工作。客户端通过单个TCP端口将命令和文件I/O转发到服务器,服务器执行一个补丁后的ffmpeg。重要的是,文件*从不*驻留在服务器上,从而无需NFS、SMB或复杂的挂载。 包含支持NVENC、QSV和其他硬件加速方法的预构建二进制文件,简化了设置。多个客户端可以同时连接到单个服务器,每个客户端都有自己的ffmpeg进程,并受到HMAC身份验证的保护。它是一种简化解决方案,可在Docker、VM和远程机器等各种环境中利用GPU性能。

每日HackerNews RSS

## AMI 启动,获得 10 亿美元资金,致力于“世界模型”人工智能 Meta 前首席人工智能科学家 Yann LeCun 在巴黎联合创立了 Advanced Machine Intelligence (AMI),获得了超过 10 亿美元的资金,用于开发人工智能“世界模型”。LeCun 认为,当前人工智能的发展,专注于像 ChatGPT 这样的大型语言模型 (LLM),是实现真正人类水平智能的死胡同。他认为,人工智能需要理解*物理*世界,而不仅仅是语言,才能真正地推理和规划。 AMI 估值 35 亿美元,旨在创建具有持久记忆、可控性和安全性的 AI 系统,目标行业包括制造业、生物医学和机器人技术。该公司将在巴黎、蒙特利尔、新加坡和纽约等地全球运营。 这项举措代表着对 OpenAI 甚至 LeCun 前雇主 Meta 所倡导的 LLM 方法的重大反*对*。虽然承认 LLM 的实用性,但 LeCun 将其视为一种临时趋势,认为世界模型对于真正的人工智能发展至关重要,并且最好独立商业化。他获得了 Zuckerberg 的祝福,离开了 Meta 来追求这一愿景。

## AI辅助编程:熟练度等级 人工智能的编程*能力*正在迅速提升,但要充分发挥其*益处*,需要培养有效利用它的技能。这种进步并非追求最高的SWE-bench分数,而是弥合人工智能*能够*做的事情与我们如何*应用*它之间的差距。 作者概述了**八个**AI辅助编程熟练度等级。它从基本的**代码补全**(等级1)等功能开始,逐步发展到利用AI驱动的IDE进行多文件编辑(等级2)。**上下文工程**(等级3)——优化提示的清晰度——至关重要,并演变为**复合工程**(等级4),将经验教训编码为未来会话的规则。 等级5-7通过**定制工具和技能**(MCPs)解锁显著收益,赋予人工智能访问数据库、API和测试框架的权限,并最终**编排后台代理**以自主处理任务。当前的边界,**等级8**,涉及完全自主的代理团队直接协调,但管理复杂性仍然存在挑战。 关键要点是,每一层都建立在上一层之上,通过改进的模型来放大收益。在团队范围内投资熟练度——确保每个人不会被速度较慢的同事拖累——至关重要。未来指向更自然的界面,如语音控制,但核心原则仍然是:迭代开发,由越来越强大和自主的人工智能代理提供支持。

## 从废墟中思考:摘要 本文探讨了被殖民和边缘化人民所经历的失败的持久影响,特别关注作者的伊朗巴赫蒂亚里族背景以及石油开采对其土地的影响。作者的父亲传授了一个重要的教训:以“坦然的面孔”面对不可避免的失败——一种保持脆弱和暴露的意愿,拥抱从苦难中获得的知识。 文章借鉴了弗兰茨·法农的作品,认为失败不仅仅是一种被动体验,而是理解世界的一个关键视角。这是那些历史上被殖民力量“摧毁”的人所共有的处境,也是产生独特知识和抵抗形式的催化剂。 作者将这一概念与卡尔巴拉悲剧和特立尼达的霍赛仪式等历史事件联系起来,展示了哀悼和纪念如何成为生存和政治行动的强大工具。最终,文章倡导一种“悲观的希望”——即使在不可能的情况下也要继续斗争——以及一种能够设想在系统性不公正的废墟之外的生活的激进想象力。因此,失败不是终结,而是批判性思考的一种方法和未来可能性基础。

## 开源机器学习的简单幻觉

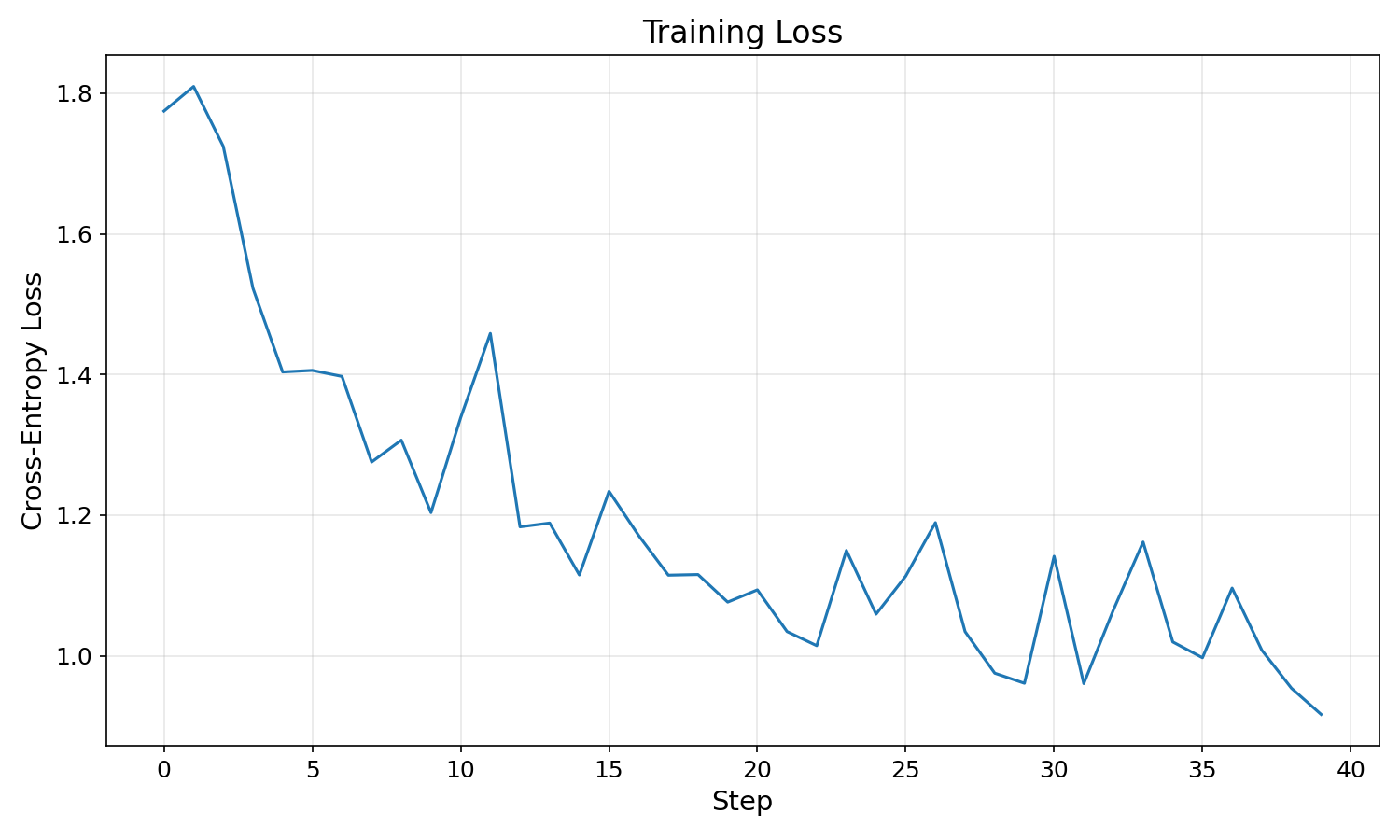

一位大学教授的建议——“如果出现错误,那是你的错”——对于大多数软件来说是适用的,但在开源机器学习基础设施方面却不成立。作者在尝试廉价地对Kimi-K2-Thinking(一个拥有1万亿参数的模型)进行后训练时,亲身体验了这一点。尽管Hugging Face上有现成的模型,但一个可用的训练流程却出乎意料地难以实现。

最初使用LLaMA-Factory和Hugging Face的Transformers库的尝试充满了错误,从由于冗余量化导致的无法解释的压缩延迟,到需要一个特定的、未记录的PyTorch设置才能解决GPU内存管理问题。进一步的障碍包括GPU上的权重分布不均匀、LoRA与量化权重的不兼容,以及由于不可微分的MoE门而阻止训练的关键断言错误。

最终,作者实现了训练——尽管速度明显较慢且成本高于使用专用API——方法是绕过抽象层并直接解决底层问题。这次经历凸显了开源ML堆栈中隐藏的“债务”,错误可能潜藏在深层的依赖关系中。虽然开源旨在 democratize AI,但作者认为,构建可靠的基础设施通常需要放弃修补,转而拥抱定制开发。

## 开源机器学习的简单幻觉

一位大学教授的建议——“如果出现错误,那是你的错”——对于大多数软件来说是适用的,但在开源机器学习基础设施方面却不成立。作者在尝试廉价地对Kimi-K2-Thinking(一个拥有1万亿参数的模型)进行后训练时,亲身体验了这一点。尽管Hugging Face上有现成的模型,但一个可用的训练流程却出乎意料地难以实现。

最初使用LLaMA-Factory和Hugging Face的Transformers库的尝试充满了错误,从由于冗余量化导致的无法解释的压缩延迟,到需要一个特定的、未记录的PyTorch设置才能解决GPU内存管理问题。进一步的障碍包括GPU上的权重分布不均匀、LoRA与量化权重的不兼容,以及由于不可微分的MoE门而阻止训练的关键断言错误。

最终,作者实现了训练——尽管速度明显较慢且成本高于使用专用API——方法是绕过抽象层并直接解决底层问题。这次经历凸显了开源ML堆栈中隐藏的“债务”,错误可能潜藏在深层的依赖关系中。虽然开源旨在 democratize AI,但作者认为,构建可靠的基础设施通常需要放弃修补,转而拥抱定制开发。

## Autonoma 的彻底转型:从头重写 经过 1.5 年的开发和多次转型(企业搜索、代码代理、质量保证测试),Autonoma 正在重建其产品,尽管最近获得了客户和资金。 核心原因? 最初的一个令人遗憾的决定,即为了速度而牺牲代码质量,放弃测试和严格的 TypeScript。 最初,“无测试”的方法对于小型团队来说是可行的,但迅速导致了充满错误且难以维护的代码库,最终导致失去了一个客户。 认识到造成的损害,Autonoma 现在正在采用测试驱动开发方法,并使用严格的 TypeScript。 这次重写还涉及重大的技术栈转变。 他们正在放弃 Next.js 及其存在问题的服务器动作——引用了异步行为、测试困难和全局顺序执行的问题——转而使用 React 与 tRPC 以及 Hono 后端,以提高效率和降低成本(将资源使用量从 8GB 降低到接近免费)。 编排由 Kubernetes 原生的 Argo 处理,因为它在管理复杂的状态化工作流方面具有可靠性和可扩展性。 虽然具有挑战性,但这种方法避免了像 useworkflow.dev 和 Temporal 这样较新的工作流工具的限制。 Autonoma 欢迎反馈,并计划在几周内发布新产品。

## 民主化企业知识:企业上下文层 构建一个全面、自我更新的公司知识库——“企业上下文层”(ECL)—— 令人惊讶地是可以实现的。尽管围绕复杂解决方案(如知识图谱)存在炒作,但最近的实验表明,仅使用 1,000 行 Python 代码和一个 GitHub 仓库就能取得成功。 挑战在于超越简单的文档检索,去*理解*公司的细微差别:产品消歧、发布细节、内部流程和冲突信息。现有的解决方案难以实现这种整体视图。 关键在于使用 AI 代理映射组织的各个方面——产品、人员、流程——并且至关重要的是,为每个声明*引用来源*,创建一个可追溯、可验证的知识库。这种方法不追求可读性,而是追求准确性和上下文。 该实验涉及 20 个代理生成 6,000 次提交,跨 1,020 个文件,映射从客户旅程到功能标志清单的所有内容。 结果系统超越了现有的检索系统,甚至可以识别出最适合路由到专业团队的敏感问题。 这并非一个产品,而是一种实践——所有公司内部 AI 代理的基础层,由机器构建和维护,并且随着 LLM 的改进而日益普及。 未来设想将从定制 AI 代理转向利用共享的、机器维护的上下文层来获取所有组织知识。

## “氛围编码员”的变现问题 当前人工智能驱动的创作工具的一个关键问题是,虽然它们赋能了一批新的“氛围编码员”——那些无需传统编程即可构建应用程序的个人,但它们常常使变现变得复杂且昂贵。这些创作者面临着大量的“金融科技细节”和高昂的订阅费用(成功的课程可能每年超过10万美元),仅仅为了处理支付和基本的业务功能。 作者建议从传统的SaaS定价模式转向**基于成果的收入分成**。平台(如Lovable)可以不收取月费,而是抽取创作者收入的一部分(5-30%),从而使双方的激励目标保持一致,实现共同成功。这种模式将解锁对关键基础设施的访问——简化的支付、订阅管理、支持——这些目前对许多创作者来说是难以企及的。 “Lovable合作伙伴计划”可以提供白手套服务,随着成功而扩展支持,甚至提供迁移协助。重要的是,这些服务将产生有价值的数据,为平台创造复利优势,并改进其为所有用户提供的服务。最终目标?赋能氛围编码员建立繁荣的企业,并有可能向创作者支付10亿美元。这种方法认识到,未来属于那些优先考虑无摩擦变现和共享成功的平台。

几个世纪以来,人类通过神秘主义解释未知,然后过渡到科学——寻求像E=mc²这样简洁的解释。这对于可以分解为可理解部分的“复杂”系统来说效果非常好,但在气候变化或经济等真正“复杂”的系统中却失效了,因为这些系统的相互作用*创造*了行为。圣菲研究所几年前就意识到了这一点,发现了复杂系统中的模式,但缺乏*利用*这些知识的工具。 如今的AI,特别是大型语言模型,提供了一个突破。与之前的尝试不同,这些模型之所以*有效*,是因为它们能够容纳表示复杂性所需的大量数据——仅靠笔和纸是无法做到的。模型*就是*理论,尽管是一个庞大的理论。 虽然这似乎与简洁优雅理论的理想相矛盾,但这些模型的底层*架构*——例如Transformer——却非常紧凑,并展现了跨越不同领域的潜力。通过“机制可解释性”研究这些训练好的模型,可能会揭示压缩本身*内部*的基本真理,从而提供一种新的理解途径。这表明过去无法解决的问题并非无法解决,而是超出了我们的理论媒介。我们正在从寻求因果机制转向构建预测模拟,接受概率置信度而不是确定性输出——这是对复杂世界的一种新的认知方式。

启用 JavaScript 和 Cookie 以继续。