## Swift 与 Raylib:简易 C 互操作演示 尽管像 Ladybird 浏览器 Swift 采用遭遇挫折,作者展示了 Swift 的强大和易用性,尤其是在与 C/C++ 库交互时。他们挑战了对 Swift 生态系统的批评,在无需手动 FFI 绑定情况下,为 macOS 和 Web (使用 WASI) 构建了一个基本的 Raylib 游戏。 Swift 利用 Clang 导入器将 C 头文件无缝转换为 Swift 可理解的模块。这允许直接在 Swift 项目中包含 C 头文件和静态库,该项目由 Swift 包管理器管理。作者的项目结构将 Raylib 的 C 代码(每个平台的头文件和库)与其自己的 Swift 代码分开。 为 WASM 构建需要更多努力,包括一个小的 C 存根来处理浏览器环境中的终端请求,并利用 `emcc` 进行最终编译。一个关键收获是 Swift 能够以最少的代码更改构建 Web,并借助 `ASYNCIFY` 等工具来防止浏览器冻结。 最终,作者发现这个过程“简单”,强调了 Swift 在游戏开发和其他需要 C/C++ 集成的项目中的潜力。完整的项目可在 GitHub 上获取。

每日HackerNews RSS

## 黑格尔:适用于每种语言的基于属性的测试 Hypothesis(一个流行的 Python 基于属性的测试库)的创建者发布了 **Hegel**,这是一个新的基于属性的测试库系列,旨在为多种语言带来 Hypothesis 质量的测试。其核心思想是利用 Hypothesis 强大的数据生成和缩小能力,通过集中运行 Hypothesis 并提供特定于语言的客户端库来实现。 目前适用于 **Rust**(**Go** 即将推出,C++、OCaml 和 TypeScript 的版本正在开发中),Hegel 允许开发者定义代码应该保持的*属性*——例如“解析分数不应崩溃”——而不是编写大量的特定测试用例。这种方法有效地创建了无数的测试,揭示了由于意外输入(例如“0/0”)或复杂逻辑中的错误而导致的崩溃等错误。 Hegel 特别适用于发现常见的错误类型,例如忽略零值或结构不变性问题。它还与 **Antithesis**(一个错误查找平台)集成,以增强测试能力。虽然目前需要 Python,但长期目标是减少这种依赖并提高性能。该项目还包括利用 AI 代理*编写*基于属性的测试的工具,从而降低了入门门槛。 Hegel 目前处于“开发者预览”阶段,但承诺未来基于属性的强大测试将适用于更广泛的编程语言。

## notermsnoconditions.com - 条款摘要 本网站运营基于极其简单的条款:您可以将其用于任何合法目的,在其内容基础上进行构建,并自由引用。但它**绝对没有任何保证或义务**。 本网站不提供关于准确性、可用性或适用性的任何保证。访问不受限制,内容不经过审查或支持。用户对其使用本网站所产生的行为和创作负全部责任。 重要的是,这些条款是*全部*协议——没有隐藏条款、附加条款或暗示条件。创建者不提供任何支持、服务承诺或保存承诺。 欢迎您在其他地方重用这些条款,但鼓励您谨慎使用。本质上,请自行承担风险并承担全部责任。

请启用 JavaScript 并禁用任何广告拦截器。

## 拉瓜迪亚机场安全隐患先于致命碰撞 在拉瓜迪亚机场最近一次碰撞导致两名飞行员死亡、41人受伤的几个月前,飞行员曾向美国宇航局提交多份安全报告,详细记录了险些相撞事件和对空中交通管制的担忧。报告强调,空中管制员压力越来越大,正在突破运营限制,尤其是在恶劣天气期间,这与2025年发生的致命事故相似。飞行员报告称,由于过早的起飞许可和关于飞机间距的不充分指导,发生了多次险些相撞的情况,其中一名飞行员通过推迟降落险险避免了一起潜在事故。 这些担忧与对加拿大航空快运航班和消防车之间碰撞事件的调查同时发生。初步调查结果显示,承认之前有过“紧急情况”的管制员错误地允许消防车穿越跑道。这起事件引发了对美国机场系统性压力的担忧,这些压力源于过去的人员削减、老化的设备以及最近的政府停摆对TSA人员配置的影响,导致了严重的延误——甚至阻碍了调查人员进入坠机现场。 之前的多起事件,包括滑行道碰撞和险些相撞,进一步凸显了拉瓜迪亚机场日益增长的安全隐患。

启用 JavaScript 和 Cookie 以继续。

## 海洋中意想不到的时间守护者 地球上的生命以大约24小时的周期运作——昼夜节律——控制着从睡眠到新陈代谢的一切,由内部生物钟驱动,并以阳光为校准。这些生物钟基于CLOCK和BMAL1等基因,出乎意料地广泛存在,甚至出现在像藻类这样简单的生物体中。 然而,最近对日本海岸附近新发现的一种水母物种的研究挑战了我们对这些节律的理解。这种水螅纲动物拥有功能性的昼夜节律,尽管*缺乏*大多数动物钟的核心基因。 值得注意的是,它的生物钟以20小时的周期运行,并且似乎与产卵计时器有关。 这一发现表明,替代的、非常规的钟机制可能比以前认为的更常见。科学家们现在正在质疑,仅仅关注已知的“钟基因”是否限制了我们在动物王国中寻找多样化的计时系统能力,从而可能重写我们对生物时间的理解。

## AI 对软件生产的“AI效应”:一次客观评估

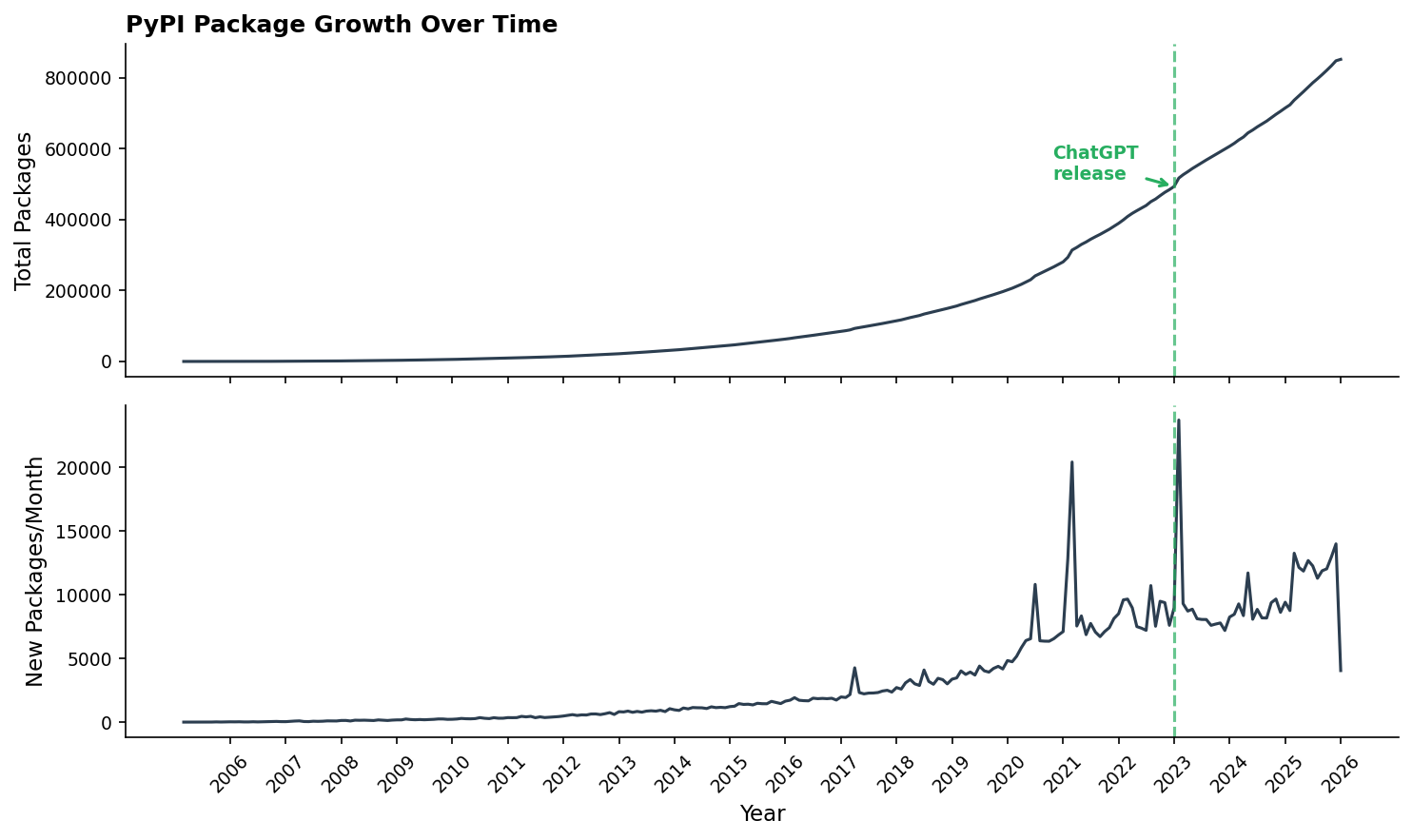

尽管有说法称AI编码工具能带来巨大的生产力提升(2倍到100倍!),但近期对Python软件包索引(PyPI)的分析显示情况更为复杂。ChatGPT发布后,整体软件创作并未激增;新的软件包*创建*速率保持稳定,甚至出现由垃圾信息而非实际开发引起的激增。

软件包*更新*略有增加,但这一趋势在现代AI工具兴起*之前*就已经开始,很可能是由持续集成实践的采用推动的。然而,一个显著的影响是可见的:**关于AI的软件包更新频率更高**,尤其是那些越来越受欢迎的软件包。流行的AI相关软件包的更新频率比非AI软件包高出2倍以上。

这并非所有开发者的普遍生产力提升。相反,数据表明这是一种集中效应,由两个潜在因素驱动:构建AI工具的开发者可能更擅长*使用*AI工具,并且——至关重要的是——**围绕AI的大量投资和炒作正在推动AI生态系统内部的开发和迭代。**

“AI效应”并非所有软件的寒武纪大爆发,而是围绕AI软件的一次集中爆发。

## AI 对软件生产的“AI效应”:一次客观评估

尽管有说法称AI编码工具能带来巨大的生产力提升(2倍到100倍!),但近期对Python软件包索引(PyPI)的分析显示情况更为复杂。ChatGPT发布后,整体软件创作并未激增;新的软件包*创建*速率保持稳定,甚至出现由垃圾信息而非实际开发引起的激增。

软件包*更新*略有增加,但这一趋势在现代AI工具兴起*之前*就已经开始,很可能是由持续集成实践的采用推动的。然而,一个显著的影响是可见的:**关于AI的软件包更新频率更高**,尤其是那些越来越受欢迎的软件包。流行的AI相关软件包的更新频率比非AI软件包高出2倍以上。

这并非所有开发者的普遍生产力提升。相反,数据表明这是一种集中效应,由两个潜在因素驱动:构建AI工具的开发者可能更擅长*使用*AI工具,并且——至关重要的是——**围绕AI的大量投资和炒作正在推动AI生态系统内部的开发和迭代。**

“AI效应”并非所有软件的寒武纪大爆发,而是围绕AI软件的一次集中爆发。

## RYS II:在现代LLM上重复分层仍然有效 这项研究调查了“重复自我”(RYS)方法——复制Transformer模型的部分以提升性能——是否能从最初在Qwen2-72B上的成功扩展到更新、更强大的模型,如Qwen3.5-27B。核心问题是:重复分层是偶然现象,还是Transformer的普遍特性? 研究结果证实RYS仍然有效。对Qwen3.5-27B的扫描表明,复制连续的中层块可以显著提高数学推理和EQ(情商)基准测试的表现。广泛的测试,包括对3,024种配置进行Beam Search,以及使用代理模型评估200万个样本,确定了最佳的层复制方案。 关键结果表明,模型的“推理区域”——即模型以与格式无关的方式处理信息的地方——与从重复分层中获益最多的区域相符。简单、连续的块复制始终优于更复杂的组合,突出了Transformer内部存在离散的功能电路。该研究还在HuggingFace上发布了扫描代码和新的RYS模型。 最终,这项研究强化了Transformer将推理组织成可识别电路的观点,并且允许模型重新访问这些电路可以提高性能。这种方法与其他优化技术(如微调和量化)是正交的,可以提供潜在的“免费”性能提升。