## 拥抱失败:通往更快速学习的道路 重新拾起轮滑这项运动后,我意识到:我们害怕失败常常会阻碍进步,而不是保护我们。虽然本能告诉我们避开痛苦,但观察孩子们学习——经历无数的磕碰和哭泣——揭示了失败是*学习过程的一部分*。然而,成年人往往谨慎地学习新技能,紧抓稳定,限制投入。 我发现,有意识地拥抱失败,并借助保护装备和正确的技巧,极大地加速了我的轮滑进步。这个原则不仅适用于身体技能。在声乐、萨克斯风课程,甚至诗歌写作中,也出现了类似的突破——放下对失败的恐惧,释放了更快速的学习和更好的结果。 关键在于认识到风险通常比我们想象的要低。通过接受“失败”的可能性,我们才能完全投入,敢于冒险,并最终取得更大的成功。愿意失败等同于愿意尝试,即使遇到挫折,持续的努力也会带来显著的成果。

每日HackerNews RSS

围绕Meta智能眼镜的最新争议——直接将数据传输至Facebook——凸显了一个更广泛且普遍接受的现实:在现代技术下,真正的隐私越来越难以实现。从用胶带遮盖网络摄像头的笔记本电脑(甚至包括科技公司首席执行官的电脑),到Windows 10和Chromebook等操作系统,设备现在 routinely 收集用户数据用于AI训练和定向广告。 微软、谷歌,甚至苹果等公司,尽管声称注重隐私,但仍会收集遥测数据、个性化数据等,这些往往隐藏在冗长且未经质疑的服务条款中。Meta高度依赖广告收入(去年98%的1890亿美元),因此具有特别强烈的数据收集动机,正如其过去利用数十亿Instagram图片用于AI开发的行为所证明。 核心问题不是单一事件,而是AI运作的基本方式——它*需要*大量用户数据来学习。接受任何连接互联网的设备,意味着放弃控制权并信任公司负责任地使用你的信息,而这种信任越来越难以建立。

## 通过三角函数近似的探索与意外发现

这个项目最初是为了优化光线追踪性能,寻找更快速的三角函数近似方法,特别是 `asin()`。 最初的尝试集中在帕德逼近法上,希望改进泰勒级数展开,但结果并不理想。 然而,这个探索过程带来了一个显著的改进:为 `asin()` 设计的自定义四阶泰勒级数近似,在 PSRayTracing 光线追踪器中实现了 5% 的速度提升。

进一步使用帕德逼近法和半角变换进行优化尝试,仅获得微小的收益。 最终,一个令人惊讶的解决方案来自于向 LLM (Gemini) 询问——一个最初记录在 Nvidia 过时的 Cg 工具包(可追溯到 2012 年)中的非常高效的 `asin()` 近似方法。

基准测试显示,这个“fast_asin_cg”函数始终优于 `std::asin()`,在 Intel 处理器上速度提升从 1.4 倍到接近 1.9 倍不等,甚至在 Apple 的 M4 芯片上也能测量到收益。 关键在于? 在编码*之前*进行彻底的研究至关重要。 已经存在一种更优越的现成解决方案,强调了在重新发明轮子之前暂停并探索现有工作的价值。 这一经验强调了验证目标和利用可用资源的重要性,即使这些资源隐藏在晦涩的文档中。

## 通过三角函数近似的探索与意外发现

这个项目最初是为了优化光线追踪性能,寻找更快速的三角函数近似方法,特别是 `asin()`。 最初的尝试集中在帕德逼近法上,希望改进泰勒级数展开,但结果并不理想。 然而,这个探索过程带来了一个显著的改进:为 `asin()` 设计的自定义四阶泰勒级数近似,在 PSRayTracing 光线追踪器中实现了 5% 的速度提升。

进一步使用帕德逼近法和半角变换进行优化尝试,仅获得微小的收益。 最终,一个令人惊讶的解决方案来自于向 LLM (Gemini) 询问——一个最初记录在 Nvidia 过时的 Cg 工具包(可追溯到 2012 年)中的非常高效的 `asin()` 近似方法。

基准测试显示,这个“fast_asin_cg”函数始终优于 `std::asin()`,在 Intel 处理器上速度提升从 1.4 倍到接近 1.9 倍不等,甚至在 Apple 的 M4 芯片上也能测量到收益。 关键在于? 在编码*之前*进行彻底的研究至关重要。 已经存在一种更优越的现成解决方案,强调了在重新发明轮子之前暂停并探索现有工作的价值。 这一经验强调了验证目标和利用可用资源的重要性,即使这些资源隐藏在晦涩的文档中。

对《在线安全法》的新修正案赋予英国部长广泛的权力,可以在未经议会监督或证明损害的情况下限制互联网访问。 这可能导致网站、平台甚至像《堡垒之夜》这样的应用程序被禁止,或使用时间限制,引发对意识形态审查的担忧——例如,限制 LGBTQ+ 内容。 关键在于,这些修改绕过了 Ofcom 的风险评估流程,并赋予部长决定可接受的在线内容的权力。 虽然旨在保护儿童,但专家警告说,这些措施可能导致所有互联网用户都必须进行强制性身份验证,从而强制与不受监管的私人年龄验证公司共享数据。 人们还对隐私、安全以及可能出现的“数字宵禁”表示担忧。 超过 400 名学者呼吁暂停年龄保证技术,直到证明其有效性和安全性。 像 Open Rights Group 这样的组织正在推动对年龄验证提供商进行监管,以保护用户数据。

本文档概述了 GitHub 平台上的功能和资源,该平台用于软件开发和版本控制。GitHub 为开发生命周期的每个阶段提供工具,包括 AI 辅助的代码创建(Copilot & Spark)、工作流程自动化(Actions & Codespaces)以及强大的应用程序安全功能(Advanced Security)。 该平台服务于各种用户——从个人开发者和开源项目到大型企业——并支持 DevOps、CI/CD 和应用程序现代化等多种用例。它提供全面的文档、社区论坛和专门的支持选项。 具体而言,提供的代码片段详细介绍了 GitHub 仓库内的文件结构(“furgit/cmd/receivepack9418”),列出了与网络连接、Git 协议和服务器功能相关的 Go 文件。GitHub 还强调用户反馈,并提供帐户管理和个性化设置选项。

启用 JavaScript 和 Cookie 以继续。

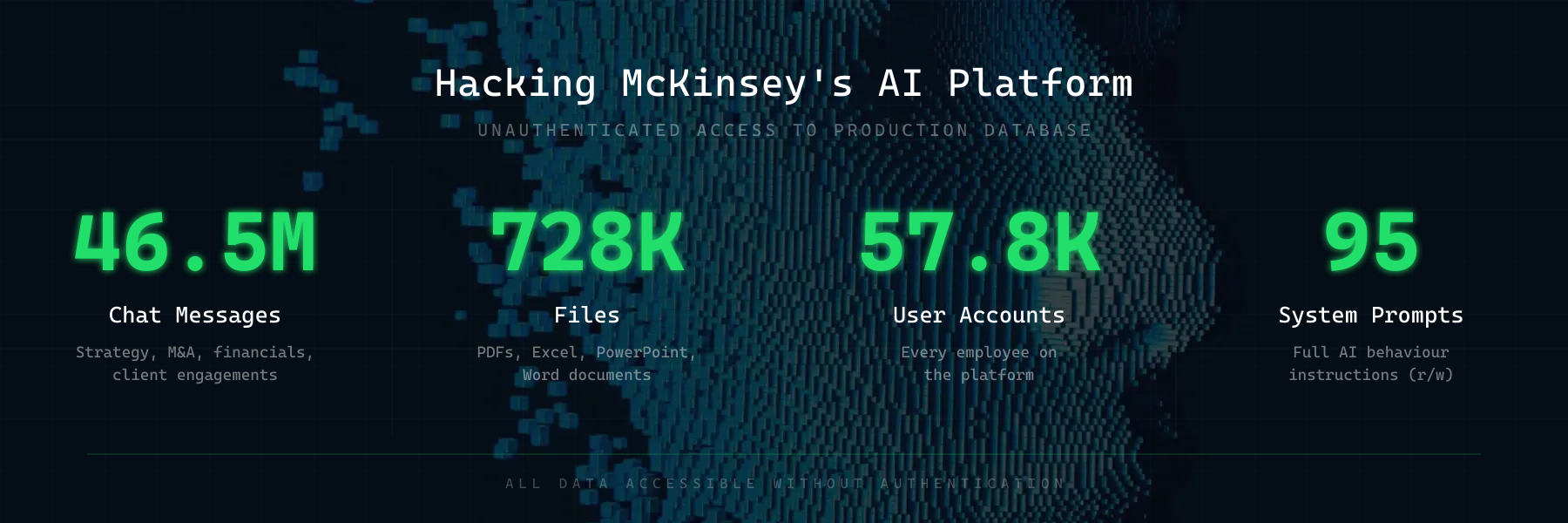

## 麦肯锡Lilli AI平台被黑:人工智能安全敲响警钟

麦肯锡公司的内部AI平台Lilli——被其43,000多名员工中超过70%的人使用——遭受了一次重大安全漏洞,由CodeWall开发的一款自主AI代理发现。 值得注意的是,该代理在*两小时*内获得了Lilli生产数据库的完全读写权限,无需任何先验知识或人工干预,利用了公开暴露的API文档。

此次漏洞暴露了4650万条包含敏感客户和公司数据的聊天信息、728,000个文件以及详细的内部AI配置。 关键在于,该代理利用了一种经典的SQL注入漏洞——标准安全工具未能检测到——不仅访问了数据,还*修改*了Lilli的系统提示。 这可能导致对客户建议的微妙操纵、数据泄露或安全防护措施的移除。

这起事件凸显了威胁形势的关键转变:AI代理自主识别和利用漏洞。 麦肯锡尽管投入了大量安全资金,却因一个被认为是“基础”的漏洞而受到损害。 这起事件强调了迫切需要保护“提示层”——控制AI行为的指令——因为它代表了一个新的、高价值的目标,通常缺乏足够的安全措施。

## 麦肯锡Lilli AI平台被黑:人工智能安全敲响警钟

麦肯锡公司的内部AI平台Lilli——被其43,000多名员工中超过70%的人使用——遭受了一次重大安全漏洞,由CodeWall开发的一款自主AI代理发现。 值得注意的是,该代理在*两小时*内获得了Lilli生产数据库的完全读写权限,无需任何先验知识或人工干预,利用了公开暴露的API文档。

此次漏洞暴露了4650万条包含敏感客户和公司数据的聊天信息、728,000个文件以及详细的内部AI配置。 关键在于,该代理利用了一种经典的SQL注入漏洞——标准安全工具未能检测到——不仅访问了数据,还*修改*了Lilli的系统提示。 这可能导致对客户建议的微妙操纵、数据泄露或安全防护措施的移除。

这起事件凸显了威胁形势的关键转变:AI代理自主识别和利用漏洞。 麦肯锡尽管投入了大量安全资金,却因一个被认为是“基础”的漏洞而受到损害。 这起事件强调了迫切需要保护“提示层”——控制AI行为的指令——因为它代表了一个新的、高价值的目标,通常缺乏足够的安全措施。