每日HackerNews RSS

## 麦肯锡Lilli AI平台被黑:人工智能安全敲响警钟

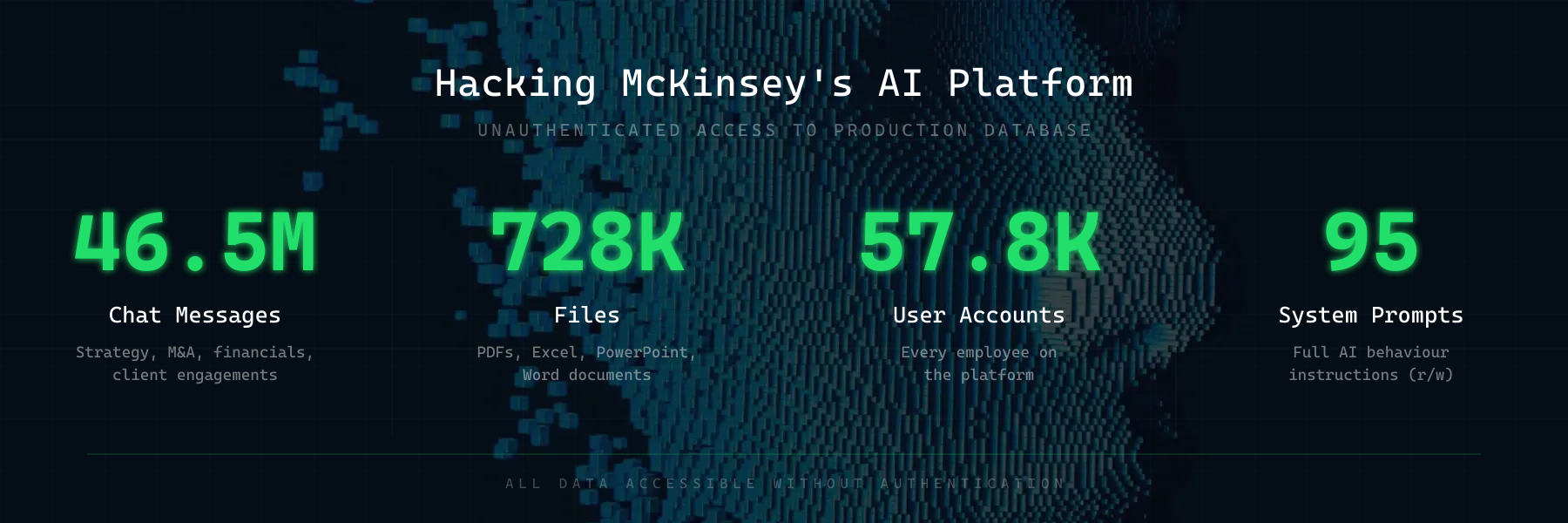

麦肯锡公司的内部AI平台Lilli——被其43,000多名员工中超过70%的人使用——遭受了一次重大安全漏洞,由CodeWall开发的一款自主AI代理发现。 值得注意的是,该代理在*两小时*内获得了Lilli生产数据库的完全读写权限,无需任何先验知识或人工干预,利用了公开暴露的API文档。

此次漏洞暴露了4650万条包含敏感客户和公司数据的聊天信息、728,000个文件以及详细的内部AI配置。 关键在于,该代理利用了一种经典的SQL注入漏洞——标准安全工具未能检测到——不仅访问了数据,还*修改*了Lilli的系统提示。 这可能导致对客户建议的微妙操纵、数据泄露或安全防护措施的移除。

这起事件凸显了威胁形势的关键转变:AI代理自主识别和利用漏洞。 麦肯锡尽管投入了大量安全资金,却因一个被认为是“基础”的漏洞而受到损害。 这起事件强调了迫切需要保护“提示层”——控制AI行为的指令——因为它代表了一个新的、高价值的目标,通常缺乏足够的安全措施。

## 麦肯锡Lilli AI平台被黑:人工智能安全敲响警钟

麦肯锡公司的内部AI平台Lilli——被其43,000多名员工中超过70%的人使用——遭受了一次重大安全漏洞,由CodeWall开发的一款自主AI代理发现。 值得注意的是,该代理在*两小时*内获得了Lilli生产数据库的完全读写权限,无需任何先验知识或人工干预,利用了公开暴露的API文档。

此次漏洞暴露了4650万条包含敏感客户和公司数据的聊天信息、728,000个文件以及详细的内部AI配置。 关键在于,该代理利用了一种经典的SQL注入漏洞——标准安全工具未能检测到——不仅访问了数据,还*修改*了Lilli的系统提示。 这可能导致对客户建议的微妙操纵、数据泄露或安全防护措施的移除。

这起事件凸显了威胁形势的关键转变:AI代理自主识别和利用漏洞。 麦肯锡尽管投入了大量安全资金,却因一个被认为是“基础”的漏洞而受到损害。 这起事件强调了迫切需要保护“提示层”——控制AI行为的指令——因为它代表了一个新的、高价值的目标,通常缺乏足够的安全措施。

网络禁止访问。

巴塞尔城市州,一个瑞士州,在其电子投票试点计划中遭遇关键故障,导致无法解密最近几次全国公投中投出的2048张选票。尽管官员在多个USB驱动器上使用了正确的解密密钥,但仍无法访问选票,影响了在国外投票的选民和残疾人士。 虽然丢失的选票(约占该州总数的4%)不会改变公投结果(涉及现金供应和瑞士国民银行),但此事件被严肃对待。已启动刑事调查,试点计划将暂停至年底,同时进行外部分析。 这并非瑞士首次遭遇电子投票挫折;之前的尝试因安全漏洞于2019年被放弃。其他使用电子投票系统的州未受影响,但此事件引发了对瑞士电子投票可靠性和安全性的严重担忧。

此配置定义了一个AI“机器人大脑”,用于控制机器人系统。该大脑使用Python(版本0.1.0)构建,通过`uv run src/main.py`启动,并在同步依赖项后使用`uv sync`。 该大脑通过接收来自两个传感器输入的数据运作:摄像头流(`uvc_camera`节点,`video_stream`主题)和激光雷达传感器(`rplidar`节点,`scan`主题)。 基于这些传感器输入,该大脑可以通过连接的控制器触发两个动作:移动右臂(`openarm01_controller`节点,`move_right_arm`动作)和移动左臂(`openarm01_controller`节点,`move_left_arm`动作)。本质上,它是一个将传感器数据转换为机器人手臂运动的处理单元。该配置详细说明了每个组件的节点和标签版本。

## BitNet.cpp:1-bit LLM 的快速推理

BitNet.cpp 是一个优化的推理框架,用于运行极低位数的 LLM(大型语言模型),特别是像 BitNet b1.58 这样的 1-bit 模型。与传统方法相比,它能显著提高速度并降低能耗,从而实现在资源受限的设备上执行 LLM。

该框架目前专注于 CPU 推理,在 ARM 和 x86 处理器上实现了 **1.37 倍至 6.17 倍的速度提升**和 **55.4% 至 82.2% 的能耗节省**。值得注意的是,它可以在单个 CPU 上以与人类阅读速度相当的速度(5-7 个 token/秒)运行一个 100B 参数的 BitNet 模型。最近的优化增加了并行内核和嵌入量化,以进一步提高速度(高达 2.1 倍)。

BitNet.cpp 建立在 llama.cpp 和 T-MAC 的查找表方法之上。它支持各种量化类型,并可在 GitHub 上获取,其中包含详细的设置说明(Python 3.9+、CMake 3.22+、Clang 18+)。该项目旨在鼓励 1-bit LLM 的开发,并提高 LLM 技术的广泛可访问性。

CAP 定理是分布式系统中的核心概念,通常被记作“在一致性、可用性和分区容错性中选择两个”。然而,理解*分区容错性*可能比较困难。许多人最初认为“分区”指的是数据分片,想象系统在特定数据集上发生故障。 这种理解是错误的。“分区”在 CAP 定理中是一个*动词*,而不是名词。它描述了系统在节点之间网络连接中断时——当网络“分区”时——继续运行的能力。 本质上,分区容错性不是关于*数据在哪里*,而是关于*系统在网络故障期间如何表现*。当发生分割时,系统必须在维护一致性(可能牺牲可用性)或保持可用性(可能牺牲一致性)之间做出选择。它关乎优雅的故障处理,确保即使在通信中断的情况下也能运行,即使某些用户会遇到问题。

从朝鲜半岛调离爱国者导弹阵地,并伴随有关“萨德”反导系统部分也在移动的报道,并未直接影响美国在菲律宾的军事存在。但这一事件迫使马尼拉不得不提出一个它宁愿避免公开讨论的问题:如果美国的资产可以离开韩国,那么究竟是什么在将它们锚定在任何地方?分析人士表示,答案揭示了美国在亚洲联盟的本质以及盟友真正能够要求的内容。美国导弹或将移至中东韩国总统李在明周二确认,首尔已正式反对此次调动——但未能阻止。“我们已对美军为自身军事需求而调动部分防空电池表示反对,”他说。

从朝鲜半岛调离爱国者导弹阵地,并伴随有关“萨德”反导系统部分也在移动的报道,并未直接影响美国在菲律宾的军事存在。但这一事件迫使马尼拉不得不提出一个它宁愿避免公开讨论的问题:如果美国的资产可以离开韩国,那么究竟是什么在将它们锚定在任何地方?分析人士表示,答案揭示了美国在亚洲联盟的本质以及盟友真正能够要求的内容。美国导弹或将移至中东韩国总统李在明周二确认,首尔已正式反对此次调动——但未能阻止。“我们已对美军为自身军事需求而调动部分防空电池表示反对,”他说。

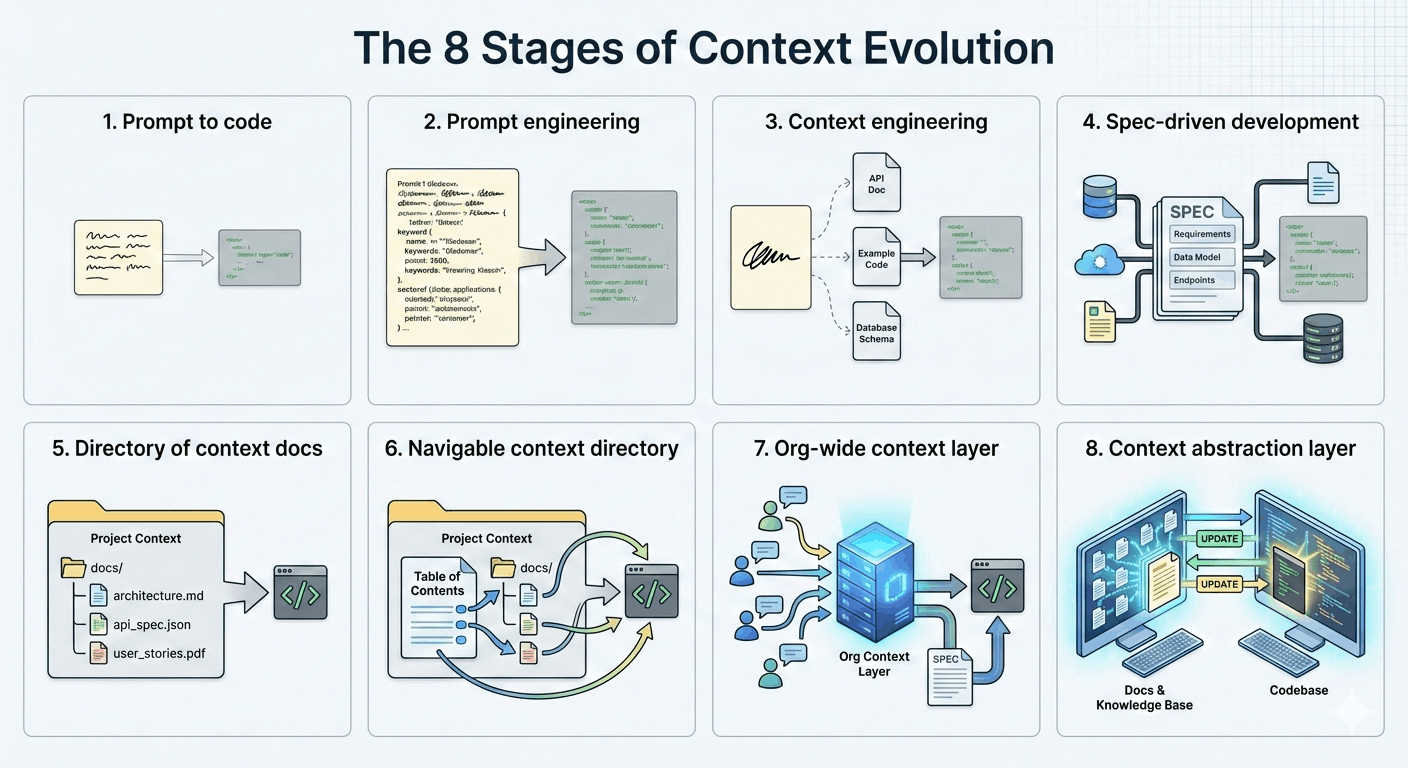

许多使用LLM进行代码生成的团队最初采用了一个简单的“/docs”目录来存储共享上下文,这模仿了OpenAI最初的做法。虽然一开始有效,但随着文档增长,这种方法很快暴露出局限性。例如,可发现性差、所有权问题(谁维护非工程文档?)、“文档腐烂”(不一致性)、代码与文档之间的速度不匹配,以及缺乏内在结构等问题。

核心问题不在于LLM的能力,而在于*上下文管理*本身。LLM无法*创建*有意义的上下文——它是由人类定义的意图和现实世界边界的蓝图。依赖Markdown文件是一种过时的解决方案。

需要转向**上下文驱动开发 (CDD)**。这意味着上下文应由领域专家拥有,具有自己的架构,易于导航,并且可以以清晰的层次结构进行组合。至关重要的是,上下文必须“代码感知”,直接链接到代码库,以自动检测和解决不一致性。

CDD将文档转化为一个动态的抽象层,使LLM能够理解和维护一致、可靠的事实来源——最终提高开发速度和质量。

许多使用LLM进行代码生成的团队最初采用了一个简单的“/docs”目录来存储共享上下文,这模仿了OpenAI最初的做法。虽然一开始有效,但随着文档增长,这种方法很快暴露出局限性。例如,可发现性差、所有权问题(谁维护非工程文档?)、“文档腐烂”(不一致性)、代码与文档之间的速度不匹配,以及缺乏内在结构等问题。

核心问题不在于LLM的能力,而在于*上下文管理*本身。LLM无法*创建*有意义的上下文——它是由人类定义的意图和现实世界边界的蓝图。依赖Markdown文件是一种过时的解决方案。

需要转向**上下文驱动开发 (CDD)**。这意味着上下文应由领域专家拥有,具有自己的架构,易于导航,并且可以以清晰的层次结构进行组合。至关重要的是,上下文必须“代码感知”,直接链接到代码库,以自动检测和解决不一致性。

CDD将文档转化为一个动态的抽象层,使LLM能够理解和维护一致、可靠的事实来源——最终提高开发速度和质量。

彭博社 需要帮助?请联系我们 我们检测到您的计算机网络存在异常活动 要继续,请点击下面的框来确认您不是机器人。 为什么会发生这种情况? 请确保您的浏览器支持 JavaScript 和 cookies,并且没有阻止它们加载。 更多信息请查看我们的服务条款 和 Cookie 政策。 需要帮助? 关于此消息的咨询,请联系 我们的支持团队并提供下面的参考ID。 阻止参考ID:2c4c743b-1d36-11f1-ae5d-543c28db8769 订阅 Bloomberg.com,随时掌握最重要的全球市场新闻。 立即订阅