球面沃罗诺伊图 (Spherical Voronoi Diagram) Jason Davies → 地图 外接圆 (Circumcircles) 德劳内三角剖分 (Delaunay triangulation) 沃罗诺伊图将空间划分为若干个区域,每个种子点对应一个区域。该区域内的所有点到对应种子点的距离,都比到其他任何种子点的距离更近。在本例中,空间为地球表面(近似为球体)。 此实现采用随机增量算法来计算球面点的三维凸包。球面点的三维凸包等同于这些点的球面德劳内三角剖分。 开发中!剩余事项: 正确处理共面点。 显示球面凸包(若点集均位于半球内,则为德劳内三角剖分的边界;否则为整个球体)。

每日HackerNews RSS

首页

关于我

博客

联系方式

社区网站

更多

首页

关于我

博客

联系方式

社区网站

首页

关于我

博客

联系方式

社区网站

Ms365news 的博客

版权所有 © 2022 Ms365news.com - 保留所有权利

隐私政策

技术支持

本网站使用 Cookie。

我们使用 Cookie 来分析网站流量并优化您的网站体验。接受我们的 Cookie 使用即表示您的数据将被汇总到所有其他用户数据中。

拒绝

接受

首页

关于我

博客

联系方式

社区网站

更多

首页

关于我

博客

联系方式

社区网站

首页

关于我

博客

联系方式

社区网站

Ms365news 的博客

版权所有 © 2022 Ms365news.com - 保留所有权利

隐私政策

技术支持

本网站使用 Cookie。

我们使用 Cookie 来分析网站流量并优化您的网站体验。接受我们的 Cookie 使用即表示您的数据将被汇总到所有其他用户数据中。

拒绝

接受

**赛博朋克图书馆**是一个精选的非营利性公共领域文献收藏库,专注于数字隐私、密码学和无政府主义哲学。该图书馆旨在为对赛博朋克理念感兴趣的人士提供资源,收录了诸如《加密无政府主义者宣言》、《网络空间独立宣言》等开创性文本,以及涉及电子现金、监控和黑客伦理的著作。该项目强调信息的自由获取,并作为安娜档案(Anna’s Archive)和 LibGen 等更广泛资源库的补充。

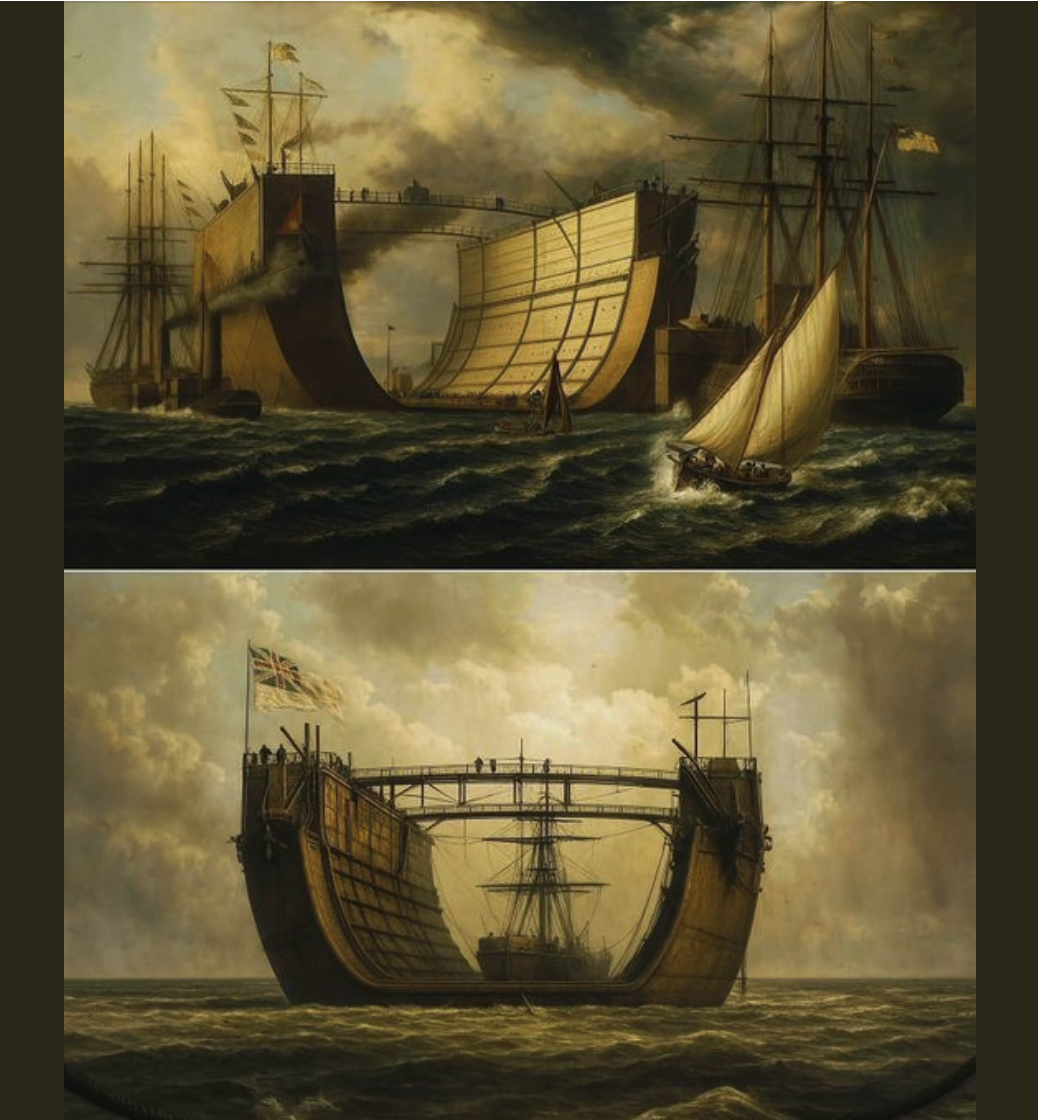

19世纪60年代,英国面临一项重大的工程挑战:如何在百慕大维修铁甲战舰。由于当地多孔的砂岩地质,建造传统的干船坞成为不可能。为了解决这一问题,工程师们建造了当时最大的浮动干船坞——一座长380英尺、重8000吨的巨型钢铁结构。

该船坞设计为U型自持平台,利用压载舱和强力泵,能将像“勇士号”(HMS Warrior)这样重达1万吨的舰船托举出水面。1869年6月,这座庞然大物开启了一段横跨大西洋、长达4000海里的壮丽旅程。在当时最强大的几艘铁甲舰(包括“阿金库尔号”和“诺森伯兰号”)的拖拽下,并辅以船帆以减少阻力,该船坞最终成功抵达百慕大。它在百慕大作为英国皇家海军的关键枢纽服役了三十多年,直到1906年退役。该项目至今仍是维多利亚时代独创性的见证,成功地通过强调机动性与规模,克服了重大的地质限制。

19世纪60年代,英国面临一项重大的工程挑战:如何在百慕大维修铁甲战舰。由于当地多孔的砂岩地质,建造传统的干船坞成为不可能。为了解决这一问题,工程师们建造了当时最大的浮动干船坞——一座长380英尺、重8000吨的巨型钢铁结构。

该船坞设计为U型自持平台,利用压载舱和强力泵,能将像“勇士号”(HMS Warrior)这样重达1万吨的舰船托举出水面。1869年6月,这座庞然大物开启了一段横跨大西洋、长达4000海里的壮丽旅程。在当时最强大的几艘铁甲舰(包括“阿金库尔号”和“诺森伯兰号”)的拖拽下,并辅以船帆以减少阻力,该船坞最终成功抵达百慕大。它在百慕大作为英国皇家海军的关键枢纽服役了三十多年,直到1906年退役。该项目至今仍是维多利亚时代独创性的见证,成功地通过强调机动性与规模,克服了重大的地质限制。

未登录用户现在可以通过电子邮件和短信订阅 GitHub 的故障更新。订阅后,用户将收到所有故障更新的电子邮件通知,而短信提醒则仅在故障创建或解决时发送。 若要启用短信通知,用户必须输入手机号码并使用一次性密码(OTP)进行验证。系统提供了支持的国际区号列表。用户也可以选择仅使用电子邮件地址进行订阅。

我们检测到此浏览器禁用了 JavaScript。请启用 JavaScript 或切换到受支持的浏览器以继续使用 x.com。您可以在我们的帮助中心查看受支持浏览器列表。帮助中心 服务条款 隐私政策 Cookie 政策 印刷信息 广告信息 © 2026 X Corp.

这份由罗斯·安德森(Ross Anderson)撰写的常见问题解答探讨了由英特尔和微软(通过TCG/TCPA和NGSCB/Palladium项目)主导的“可信计算”计划。尽管该技术被宣传为一种安全改进措施,但作者认为,这些技术从根本上将控制权从用户转移到了供应商手中。

通过安装用于验证计算机状态的硬件“Fritz”芯片,这些系统允许供应商实施严格的数字版权管理(DRM)、远程删除盗版内容并限制软件的使用。安德森指出,这种模式构建了一个“可信”系统——在安全领域,这被定义为一种能够凌驾于用户策略之上的系统——它本质上将个人电脑变成了一个可被远程控制的平台。

作者强调了其带来的严重影响:企业和政府审查的可能性、对创新的压制、对自由/开源软件(如GPL)的破坏,以及通过将用户锁定在特定的软件和硬件生态系统中来加强垄断。归根结底,安德森认为“可信计算”并非用户的福音,而是一种剥削性工具。它使相关行业能够获取租金、阻碍互操作性并巩固权力,最终威胁到现代计算所固有的自由与自主权。

这份由罗斯·安德森(Ross Anderson)撰写的常见问题解答探讨了由英特尔和微软(通过TCG/TCPA和NGSCB/Palladium项目)主导的“可信计算”计划。尽管该技术被宣传为一种安全改进措施,但作者认为,这些技术从根本上将控制权从用户转移到了供应商手中。

通过安装用于验证计算机状态的硬件“Fritz”芯片,这些系统允许供应商实施严格的数字版权管理(DRM)、远程删除盗版内容并限制软件的使用。安德森指出,这种模式构建了一个“可信”系统——在安全领域,这被定义为一种能够凌驾于用户策略之上的系统——它本质上将个人电脑变成了一个可被远程控制的平台。

作者强调了其带来的严重影响:企业和政府审查的可能性、对创新的压制、对自由/开源软件(如GPL)的破坏,以及通过将用户锁定在特定的软件和硬件生态系统中来加强垄断。归根结底,安德森认为“可信计算”并非用户的福音,而是一种剥削性工具。它使相关行业能够获取租金、阻碍互操作性并巩固权力,最终威胁到现代计算所固有的自由与自主权。

GitHub Copilot 近期的定价调整被戏称为“Tokenpocalypse”(代币末日),标志着人工智能行业正发生转变:企业正从补贴式、统一费率的模式转向基于使用量的定价模式。在 TechCrunch 的《Equity》播客中,主持人们讨论了这些不断上涨的成本如何迫使企业限制 AI 使用并重新评估预算。 随着 AI 实验室纷纷寻求 IPO,它们面临着如何平衡高昂计算成本与客户支付意愿的挑战。专家指出,最初的定价策略往往具有随意性,而随着行业成熟,AI 公司需要像当年的 Uber 一样进行运营转型,以最终实现盈利。然而,与早期的科技平台不同,AI 公司面临着难以“压缩”的、刚性的高昂基础设施成本。 随着 AI 领域飞速发展以及政府监管力度加大,投资者们开始质疑这些公司将如何定义其长期财务风险。核心的不确定性在于:AI 实验室能否足够快地降低生产成本以满足市场需求,还是说“代币化”时代会因自身无法盈利而崩塌?

这篇文章探讨了如何解读由 DINOv3 神经网络生成的、不透明的 384 维嵌入向量。由于神经网络利用“叠加”原理,将比维度更多的概念压缩进这些向量中,因此单个数值无法直接解释。

为了解码这些嵌入向量,作者采用了两部分方法:

1. **特征可视化:** 利用模型的可微分性,生成代表嵌入空间中特定点的图像,让人们能够“看见”模型感知到的内容。

2. **稀疏自编码器 (SAE):** 通过训练 SAE 将 384 维空间扩展为约 12,000 个稀疏且可解释的特征。这使得图像能够被分解为不同的组成部分(如“树木”或“桥梁”),并能够组合这些特征来观察模型如何融合概念——有时通过融合(例如玉米粒拱门),有时通过并置。

针对特定特征(如草莓)的详细实验表明,这些内部表征非常细致,能够捕捉到大小、数量和状态等特定属性。最终,这些工具为绘制和理解现代视觉模型中存储的复杂视觉词典提供了一种可扩展的方法。

这篇文章探讨了如何解读由 DINOv3 神经网络生成的、不透明的 384 维嵌入向量。由于神经网络利用“叠加”原理,将比维度更多的概念压缩进这些向量中,因此单个数值无法直接解释。

为了解码这些嵌入向量,作者采用了两部分方法:

1. **特征可视化:** 利用模型的可微分性,生成代表嵌入空间中特定点的图像,让人们能够“看见”模型感知到的内容。

2. **稀疏自编码器 (SAE):** 通过训练 SAE 将 384 维空间扩展为约 12,000 个稀疏且可解释的特征。这使得图像能够被分解为不同的组成部分(如“树木”或“桥梁”),并能够组合这些特征来观察模型如何融合概念——有时通过融合(例如玉米粒拱门),有时通过并置。

针对特定特征(如草莓)的详细实验表明,这些内部表征非常细致,能够捕捉到大小、数量和状态等特定属性。最终,这些工具为绘制和理解现代视觉模型中存储的复杂视觉词典提供了一种可扩展的方法。

科技行业目前正陷入一种既有生存恐慌,又伴随着激进“AI洗脑”的混乱状态,各路领袖都在忙于应对所谓的“SaaS启示录”。硅谷长期以来一直以颠覆其他行业为荣,但如今却面临着前所未有的转变:人工智能正在将矛头指向创造它的行业本身。 与AI在其他领域难以处理主观“真理”不同,软件开发具有独特的脆弱性。代码是可验证的,且存在海量的开源训练数据,开发者们正在构建那些威胁自身生计的工具。这种讽刺意味显而易见:那些曾经对其他行业被取代的工人不屑一顾的人,如今正面临着自身被淘汰的可能。 其结果很可能是一个熟悉的循环:价格上的恶性竞争、专业知识的贬值,以及财富向投资者和模型所有者的大规模集中。尽管有些人将AI视为生产力的增强器,但作者认为,如果没有外部干预(如监管或有组织的劳工行动),该行业将优先考虑“创造性破坏”。归根结底,这些工具的力量是不容否认的,但其发展轨迹正由那些将利润置于人类劳动力长期生存能力之上的领导者们所塑造。